Crawlers e Seu Papel no Ranqueamento em Mecanismos de Busca

Crawlers acumulam dados e informações da internet visitando sites e lendo páginas. Descubra mais sobre eles.

Descubra o que é o Google Spider (Googlebot), como ele rastreia e indexa sites e por que é essencial para o SEO. Aprenda como otimizar seu site para um melhor rastreamento.

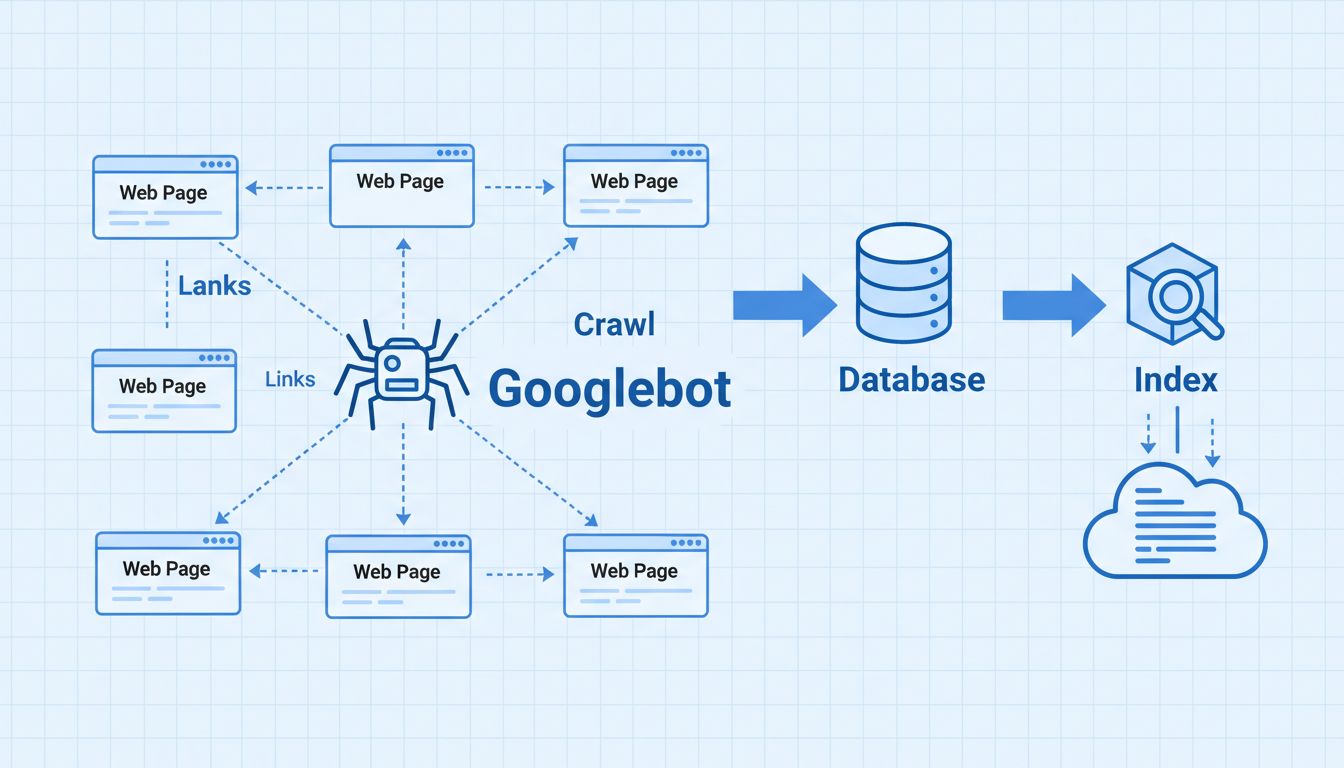

O Google Spider, conhecido formalmente como Googlebot, é um programa automatizado que rastreia sites para descobrir, indexar e armazenar conteúdos no banco de dados do Google. Ele segue links para encontrar páginas novas ou atualizadas, que são então processadas e adicionadas ao índice de buscas do Google, permitindo ao buscador oferecer resultados relevantes para os usuários.

O Google Spider, mais conhecido formalmente como Googlebot, é um programa automatizado que rastreia sistematicamente a internet para descobrir, analisar e indexar conteúdos da web. Ele é a principal ferramenta utilizada pelo Google para explorar sites, coletar informações e construir seu enorme índice de busca. Sem o Googlebot, o Google não conseguiria descobrir novas páginas, detectar atualizações em conteúdos existentes ou fornecer resultados relevantes para bilhões de usuários em todo o mundo. O spider opera continuamente, visitando milhões de sites todos os dias para garantir que o índice do Google permaneça sempre atualizado e abrangente.

O Googlebot é essencialmente um sofisticado rastreador da web que segue um processo algorítmico complexo para determinar quais sites visitar, com que frequência rastreá-los e quantas páginas buscar de cada domínio. O rastreador lê o código HTML, o conteúdo textual e os metadados de cada página que visita, armazenando essas informações no banco de dados central do Google. Esse processo de indexação é fundamental para o funcionamento dos mecanismos de busca e impacta diretamente a visibilidade do seu site nos resultados de pesquisa.

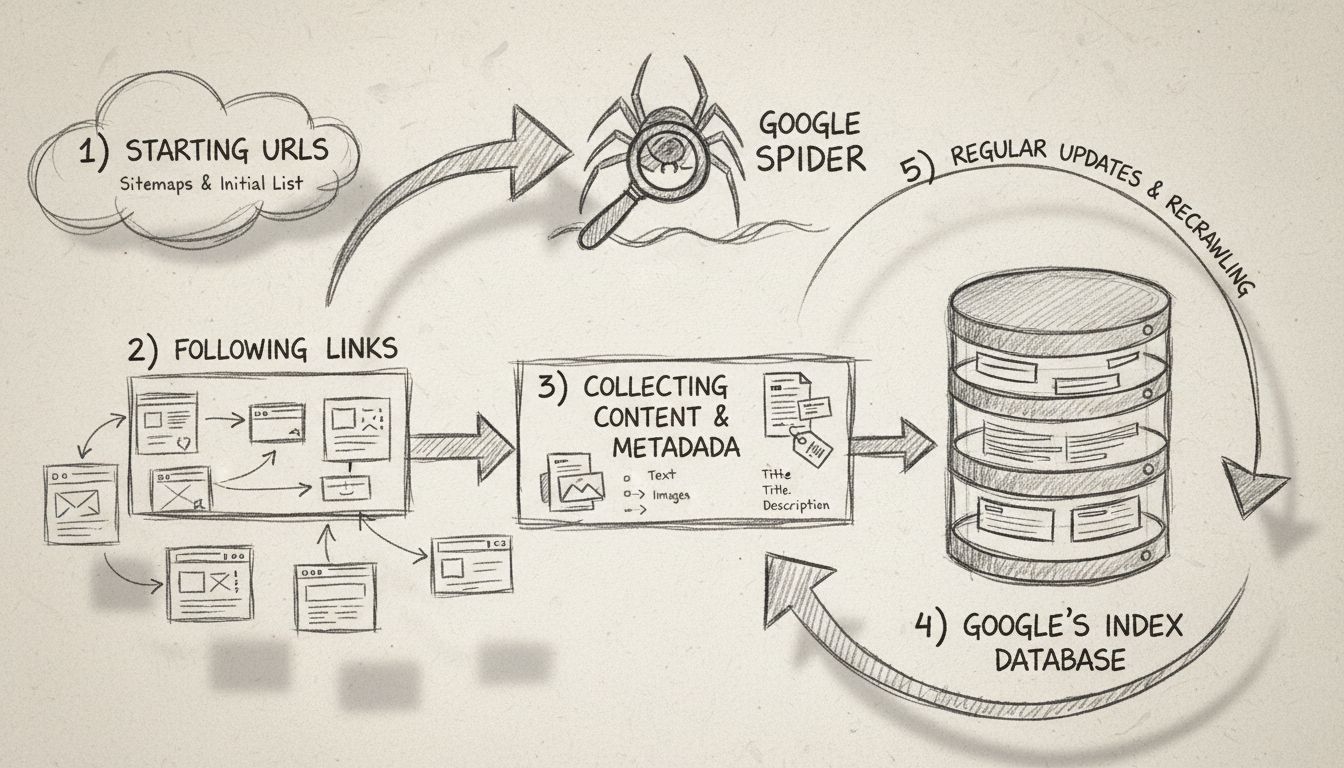

O Google Spider opera através de um processo de rastreamento bem definido, que começa com uma lista inicial de páginas conhecidas. Essa lista é gerada a partir de rastreamentos anteriores e é continuamente enriquecida com dados de sitemaps fornecidos por webmasters via Google Search Console. Quando o Googlebot visita um site, ele não apenas lê o conteúdo — realiza uma análise completa da estrutura da página, segue links internos e externos e identifica quaisquer alterações ou novos conteúdos que possam ter sido adicionados desde a última visita.

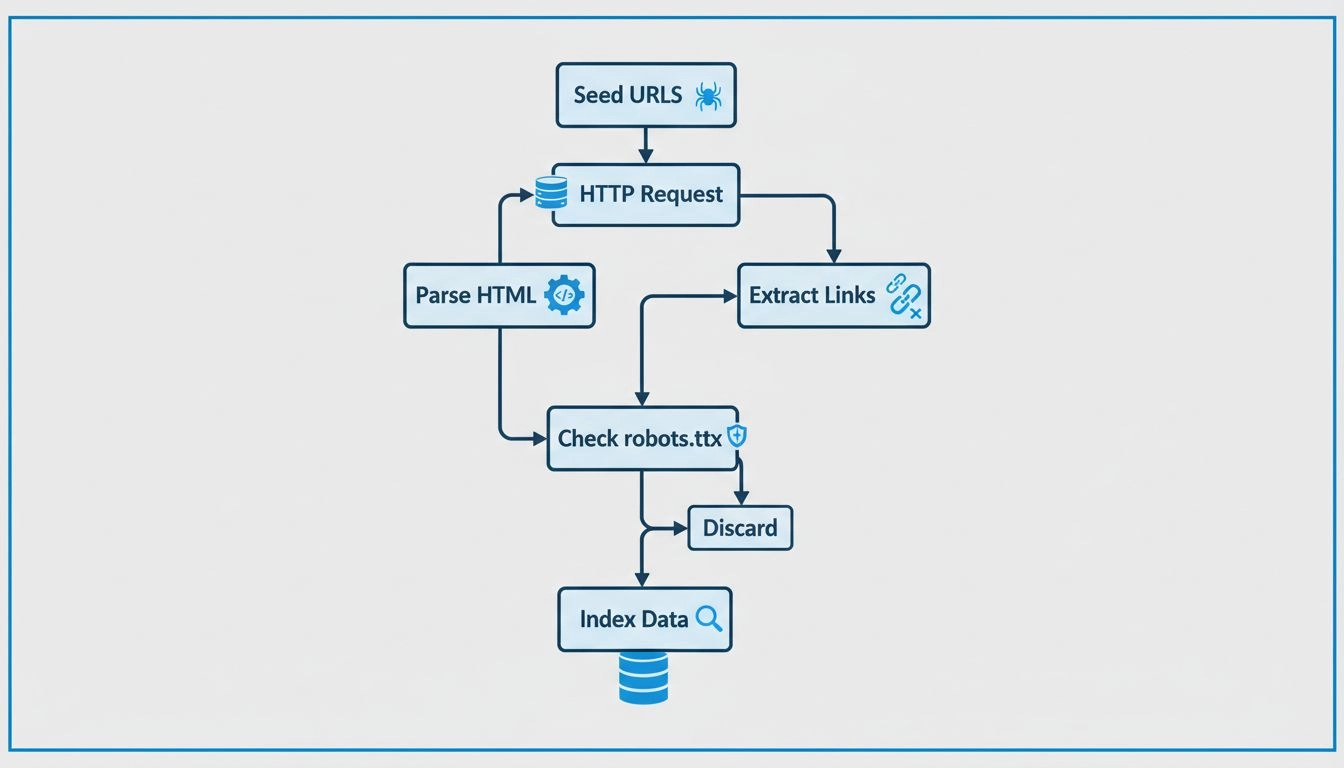

O processo de rastreamento segue estas etapas principais: Primeiro, o Googlebot começa com uma lista de URLs de páginas coletadas em rastreamentos anteriores e sitemaps. Em seguida, ele navega pelos sites seguindo links (tanto atributos SRC quanto HREF) em cada página para descobrir novos conteúdos. Terceiro, o rastreador busca e analisa o conteúdo de cada página, incluindo texto, estrutura HTML, metadados e outras informações relevantes. Quarto, esses dados coletados são enviados aos servidores do Google para processamento e armazenamento no índice de busca. Por fim, o Googlebot revisita os sites em intervalos regulares para verificar novos conteúdos, atualizações ou alterações em páginas existentes.

O Google opera diversas variantes especializadas de rastreadores, cada uma projetada para propósitos específicos e identificada por strings de user-agent únicas. Compreender esses diferentes tipos ajuda os proprietários de sites a otimizarem suas páginas para o rastreador adequado. As principais variantes do Googlebot incluem o rastreador de desktop, rastreador mobile, rastreador de vídeos, rastreador de imagens e rastreador de notícias, cada um com funções distintas no ecossistema de indexação do Google.

| Tipo de Googlebot | String User-Agent | Finalidade |

|---|---|---|

| Googlebot (Desktop) | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Rastreia versões desktop de sites para o índice geral de busca |

| Googlebot (Mobile) | Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Rastreia versões otimizadas para dispositivos móveis |

| Googlebot-Video | Googlebot-Video/1.0 | Indexa conteúdos de vídeo incorporados em páginas web |

| Googlebot-Image | Googlebot-Image/1.0 | Rastreia e indexa imagens para a busca do Google Imagens |

| Googlebot-News | Googlebot-News | Rastreia conteúdos de notícias para agregação no Google Notícias |

Além desses rastreadores principais, o Google também opera bots especializados para outras finalidades. O AdSense Bot verifica a qualidade e conformidade de anúncios, enquanto o rastreador Mobile Apps Android indexa conteúdos de aplicativos Android. Cada bot possui um identificador user-agent distinto, permitindo aos administradores de sites rastrear qual rastreador específico está acessando seu site por meio dos logs do servidor. Essa distinção é importante porque rastreadores diferentes podem ter orçamentos e prioridades de rastreamento distintos, afetando a frequência com que visitam seu site.

O Google Spider é absolutamente fundamental para a otimização de sites, pois determina se o conteúdo do seu site será descoberto, indexado e ranqueado nos resultados de busca. Se o Googlebot não conseguir rastrear seu site de forma eficiente, suas páginas não aparecerão no índice do Google, tornando-as invisíveis para possíveis visitantes que buscam seus produtos ou serviços. Por isso, o SEO técnico — garantir que seu site seja amigável aos rastreadores — é um dos principais pilares de qualquer estratégia de SEO bem-sucedida.

Quando o Googlebot rastreia seu site, ele compila um enorme índice de todas as palavras encontradas e suas localizações em cada página, além de informações HTML como títulos, meta descrições e estruturas de cabeçalhos. Essas informações indexadas são armazenadas no banco de dados do Google e utilizadas pelos algoritmos de busca para ranquear páginas e determinar a relevância do seu conteúdo para consultas específicas. Quanto mais eficiente for o rastreamento do seu site, mais frequentemente o Googlebot o visitará, e mais rápido seus novos conteúdos serão indexados e potencialmente ranqueados nos resultados.

Para garantir que o Googlebot rastreie seu site de forma eficaz e eficiente, é necessário implementar várias práticas técnicas recomendadas. Primeiro, mantenha uma estrutura de site clara e lógica, com navegação adequada que facilite ao rastreador descobrir todas as páginas importantes. O link interno deve ser estratégico e relevante, utilizando textos âncora descritivos que ajudem tanto usuários quanto rastreadores a entenderem o contexto das páginas vinculadas. Seu site deve carregar rapidamente, já que a velocidade de carregamento influencia a eficiência do rastreamento e quantas páginas o Googlebot conseguirá rastrear dentro do orçamento alocado.

Crie e envie um sitemap XML pelo Google Search Console, fornecendo ao Googlebot uma lista abrangente de todas as páginas que você deseja indexar. Isso é especialmente importante para sites grandes ou com páginas que não são facilmente encontradas apenas pela navegação interna. Além disso, certifique-se de que seu arquivo robots.txt está configurado corretamente para permitir o acesso do Googlebot às páginas que você quer indexar, bloqueando o acesso a áreas sensíveis ou conteúdos duplicados. Porém, tenha cuidado para não bloquear acidentalmente páginas importantes, pois isso as impedirá de serem indexadas.

O Google Search Console é uma ferramenta essencial para monitorar como o Googlebot interage com seu site e identificar possíveis problemas de rastreamento que possam impedir a indexação correta. A seção Estatísticas de Rastreamento fornece informações detalhadas sobre quantas páginas o Googlebot rastreou, quanto tempo gastou rastreando seu site e quantos erros encontrou. Você pode ver o tempo médio de resposta do seu servidor, que impacta diretamente a eficiência do rastreamento — servidores lentos significam menos páginas rastreadas no mesmo período.

O relatório de Cobertura no Google Search Console mostra quais páginas foram indexadas com sucesso, quais possuem erros que impedem a indexação e quais estão excluídas do índice. Essas informações são valiosas para identificar problemas técnicos como links quebrados, erros de servidor ou páginas bloqueadas pelo robots.txt que você talvez não tenha intenção de bloquear. Também é possível usar a ferramenta de Inspeção de URL para testar como o Googlebot visualiza uma página específica, inclusive se ele consegue renderizar conteúdos JavaScript e acessar todos os recursos necessários para exibir a página corretamente.

Todo site possui um “orçamento de rastreamento” — o número de páginas que o Googlebot irá rastrear em determinado período. Para a maioria dos sites, o orçamento de rastreamento não é um fator limitante, mas para sites muito grandes, com milhares ou milhões de páginas, otimizá-lo se torna importante. O Google aloca o orçamento de rastreamento com base em dois fatores: capacidade de rastreamento (quanto seu servidor suporta) e demanda de rastreamento (o quanto o Google considera seu site importante). Melhorar a velocidade do seu site e corrigir erros de rastreamento aumenta a capacidade, enquanto criar conteúdo de alta qualidade e frequentemente atualizado aumenta a demanda.

Para otimizar seu orçamento de rastreamento, elimine conteúdos duplicados que desperdiçam recursos, corrija links quebrados e cadeias de redirecionamento e remova páginas que não agregam valor aos usuários. Evite bloquear páginas importantes com robots.txt ou tags noindex e garanta que a estrutura do site permita ao Googlebot encontrar todas as páginas importantes em poucos cliques a partir da página inicial. Atualizar regularmente o sitemap XML e remover páginas desatualizadas ajudam o Googlebot a focar seu rastreamento no que é mais relevante para o seu negócio.

Proprietários de sites frequentemente enfrentam vários problemas que impedem o rastreamento eficiente pelo Googlebot. Erros de servidor (códigos de status 5xx) indicam que seu servidor está tendo dificuldades para responder, o que pode impedir a indexação de páginas. Cadeias de redirecionamento — quando uma página redireciona para outra, que redireciona para uma terceira — desperdiçam o orçamento de rastreamento e tornam a indexação mais lenta. Recursos bloqueados, como arquivos CSS ou JavaScript bloqueados pelo robots.txt, podem impedir o Googlebot de renderizar e entender corretamente suas páginas.

Erros soft 404 ocorrem quando uma página retorna código 200 (sucesso), mas contém pouco ou nenhum conteúdo de fato, confundindo o Googlebot sobre se a página deveria ser indexada. Tags noindex aplicadas acidentalmente em páginas importantes também impedem sua exibição nos resultados de busca. Tempos lentos de carregamento reduzem o número de páginas que o Googlebot pode rastrear dentro do orçamento. Para resolver esses problemas, audite regularmente seu site usando o Google Search Console, monitore os logs do servidor em busca de erros de rastreamento e use ferramentas como o Screaming Frog para identificar questões técnicas antes que elas afetem sua visibilidade.

Em 2025, o Google Spider continua sendo tão importante quanto sempre foi, embora seu papel tenha evoluído para acomodar novas tecnologias e formatos de conteúdo. O Googlebot agora consegue renderizar JavaScript, ou seja, pode rastrear e indexar conteúdos gerados dinamicamente por frameworks JavaScript. Ele também processa marcações de dados estruturados (Schema.org) para compreender melhor o conteúdo das páginas e fornecer rich snippets nos resultados de busca. Com a indexação mobile-first, o Googlebot prioriza o rastreamento e indexação da versão mobile do seu site, tornando a otimização móvel essencial para o sucesso em SEO.

O spider também desempenha papel crucial na capacidade do Google de detectar e combater spam, identificar conteúdos hackeados e garantir que os resultados de busca permaneçam relevantes e confiáveis. À medida que os mecanismos de busca evoluem com tecnologias de IA e machine learning, as capacidades de rastreamento e indexação do Googlebot tornam-se ainda mais sofisticadas, permitindo ao Google compreender melhor a intenção do usuário e entregar resultados de busca mais precisos. Compreender como o Googlebot funciona e otimizar seu site de acordo continua sendo um dos aspectos mais fundamentais de qualquer estratégia de SEO.

Assim como o Google Spider rastreia e indexa seu conteúdo, o PostAffiliatePro ajuda você a monitorar e otimizar o desempenho do seu marketing de afiliados. Acompanhe cada clique, conversão e comissão com nossa plataforma líder de gestão de afiliados.

Crawlers acumulam dados e informações da internet visitando sites e lendo páginas. Descubra mais sobre eles.

Descubra como funcionam os web crawlers, desde URLs iniciais até a indexação. Entenda o processo técnico, tipos de crawlers, regras do robots.txt e como eles im...

Spiders são bots criados para spamming, que podem causar muitos problemas para o seu negócio. Saiba mais sobre eles no artigo.

See our privacy policy.