Domínios Sombra

Domínios sombra são domínios não autorizados ou maliciosos que imitam sites legítimos para desviar tráfego, manipular classificações de mecanismos de busca ou r...

Saiba por que páginas sombra prejudicam o SEO, como desperdiçam o orçamento de rastreamento, criam problemas de conteúdo duplicado e descubra estratégias comprovadas para eliminá-las do seu site.

Sim, páginas sombra geralmente são ruins para SEO. Elas desperdiçam o orçamento de rastreamento, criam problemas de conteúdo duplicado, diluem a autoridade dos links e impactam negativamente a experiência do usuário. Os mecanismos de busca podem penalizar sites com excesso de páginas sombra, levando a quedas no ranking e menor visibilidade orgânica.

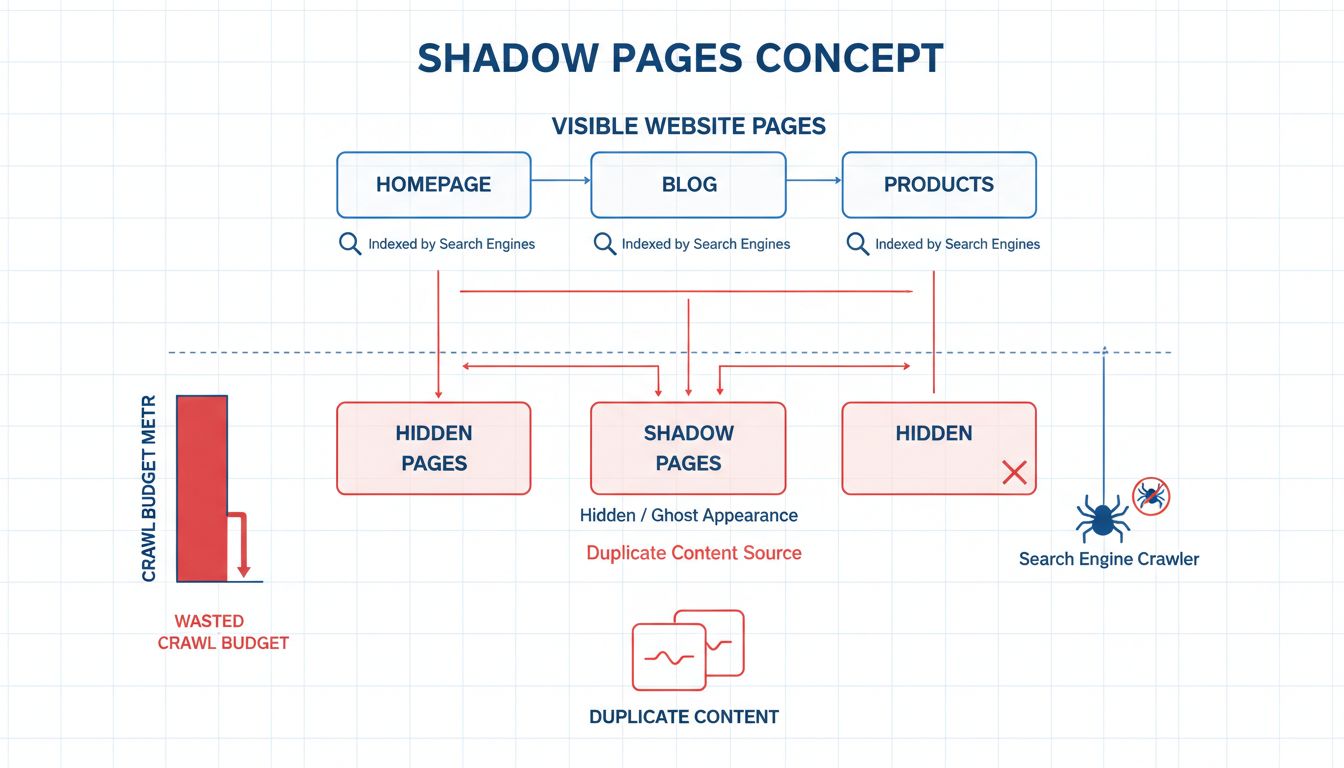

Páginas sombra, também conhecidas como páginas fantasma, são páginas web que existem em seu site, mas permanecem ocultas para os usuários e muitas vezes não são indexadas pelos mecanismos de busca. Essas páginas geralmente surgem de forma não intencional devido à má arquitetura do site, geração dinâmica de conteúdo sem o devido link interno, ou gerenciamento inadequado de redirecionamentos. Diferentemente de páginas ocultas intencionais que servem a propósitos específicos, as páginas sombra representam um problema estrutural que os mecanismos de busca têm dificuldade para categorizar e indexar corretamente. O principal problema é que essas páginas consomem recursos valiosos sem contribuir significativamente para o desempenho de SEO ou para a experiência do usuário no seu site.

A presença de páginas sombra cria uma série de problemas em cascata que se agravam com o tempo. Quando os rastreadores dos motores de busca encontram essas páginas, precisam decidir se devem rastreá-las e indexá-las, desviando atenção do conteúdo mais importante. Essa ineficiência se torna cada vez mais problemática à medida que seu site cresce, pois os mecanismos de busca destinam um orçamento de rastreamento limitado para cada domínio. Cada segundo gasto rastreando páginas sombra é um segundo que não será usado para rastrear páginas realmente relevantes para os objetivos do seu negócio e para as métricas de engajamento do usuário.

Mecanismos de busca como o Google destinam um orçamento de rastreamento específico para cada site, baseado em sua autoridade, tamanho e frequência de atualização. Esse orçamento representa o número máximo de páginas que o Googlebot irá rastrear em determinado período. Quando páginas sombra consomem parte desse orçamento limitado, menos páginas importantes são rastreadas e indexadas de forma oportuna. Para sites grandes, com milhares de páginas, isso se torna uma questão crítica que afeta diretamente a rapidez com que novos conteúdos são descobertos e ranqueados.

O problema do orçamento de rastreamento é especialmente grave quando as páginas sombra são geradas dinamicamente com IDs de sessão, parâmetros de rastreamento ou outras variações de URL. Cada variação aparece como uma página única para os mecanismos de busca, multiplicando exponencialmente o desperdício do orçamento de rastreamento. Uma única página de produto, com múltiplas combinações de parâmetros, pode gerar dezenas de páginas sombra, cada uma consumindo orçamento que poderia ser usado para conteúdo realmente importante para o negócio. Essa ineficiência faz com que seus posts de blog, páginas de produtos e descrições de serviços possam levar semanas ou meses para serem totalmente indexados, em vez de dias.

Páginas sombra frequentemente contêm conteúdo idêntico ou quase idêntico ao de páginas que já estão indexadas no seu site. Quando os mecanismos de busca encontram múltiplas versões do mesmo conteúdo, enfrentam um dilema: qual versão deve ranquear para a palavra-chave alvo? Essa confusão leva à canibalização de palavras-chave, onde suas próprias páginas competem entre si pelos rankings. Em vez de consolidar forças em uma única página autoritativa, o valor de SEO se dilui em várias páginas, resultando em desempenho geral mais fraco.

O problema do conteúdo duplicado vai além da confusão de ranqueamento. Os algoritmos do Google são projetados para identificar e penalizar sites que parecem estar criando conteúdo duplicado de forma deliberada para manipulação. Embora as páginas sombra geralmente sejam acidentais, os sistemas do Google nem sempre conseguem distinguir entre duplicatas acidentais e spam intencional. Isso significa que seu site corre o risco de receber penalidades manuais ou algorítmicas que podem reduzir significativamente sua visibilidade em todos os resultados de busca, não apenas nas páginas duplicadas.

Backlinks são um dos fatores de ranqueamento mais importantes no algoritmo do Google, representando votos de confiança de outros sites. Quando páginas sombra acumulam backlinks — seja através de links internos ou referências externas — essa autoridade é distribuída por múltiplas páginas, em vez de ser concentrada no seu conteúdo principal. Essa diluição enfraquece a autoridade das páginas principais e reduz sua capacidade de ranquear para palavras-chave competitivas.

O link interno se torna especialmente problemático com páginas sombra. Se sua arquitetura de site cria múltiplas URLs para o mesmo conteúdo, e algumas dessas URLs recebem links internos enquanto outras não, você está essencialmente dividindo sua autoridade de links. Uma página que deveria receber dez links internos pode receber apenas cinco, enquanto a versão da página sombra recebe os outros cinco. Essa fragmentação impede que qualquer página acumule autoridade suficiente para ranquear de forma eficaz para palavras-chave de alto valor.

Entender como as páginas sombra se formam é essencial para preveni-las. Parâmetros dinâmicos de URL representam uma das causas mais comuns, onde IDs de sessão, códigos de rastreamento ou preferências de usuário criam URLs únicas para conteúdos idênticos. Lojas virtuais frequentemente enfrentam esse problema quando filtros de produto, opções de ordenação ou preferências de exibição geram novas URLs. Sistemas de gerenciamento de conteúdo às vezes criam páginas sombra por meio de parâmetros de paginação, versões para impressão ou URLs específicas para mobile que não estão devidamente consolidadas com tags canônicas.

Implementação inadequada de redirecionamentos também gera páginas sombra. Quando sites migram conteúdo, alteram estruturas de URL ou consolidam páginas, as URLs antigas devem redirecionar para as novas usando redirecionamentos 301. Se esses redirecionamentos não forem configurados corretamente, os mecanismos de busca podem indexar tanto as URLs antigas quanto as novas, criando problemas de conteúdo duplicado. Da mesma forma, sites que não implementam corretamente redirecionamentos para HTTPS ou não consolidam as versões www e não-www acabam criando múltiplas páginas sombra que competem por rankings.

Tags canônicas informam aos mecanismos de busca qual versão de uma página deve ser considerada a principal quando múltiplas URLs contêm conteúdo semelhante ou idêntico. Ao adicionar uma tag rel=“canonical” às páginas sombra, você consolida os sinais de ranqueamento e impede que os mecanismos de busca desperdicem o orçamento de rastreamento em versões duplicadas. A tag canônica deve apontar para a versão principal da página que você deseja ranquear nos resultados de busca.

A implementação correta das tags canônicas exige planejamento cuidadoso. Para lojas virtuais com filtros de produtos, a tag canônica nos resultados filtrados deve apontar para a página base do produto. Para conteúdo paginado, cada página deve ter uma tag canônica autorreferencial, ou você pode usar as tags rel=“next” e rel=“prev” para indicar a relação entre as páginas. O importante é garantir que todas as páginas sombra indiquem claramente qual página deve receber o crédito do ranqueamento.

A meta tag noindex impede que mecanismos de busca indexem páginas específicas, mas ainda permite que sejam rastreadas e acessíveis aos usuários. Essa abordagem funciona bem para páginas que servem a propósitos internos, mas não devem aparecer nos resultados de busca, como páginas de agradecimento, login ou resultados de busca interna. Ao aplicar noindex em páginas sombra que não agregam valor aos usuários do buscador, você impede que elas consumam orçamento de rastreamento e concorram com seu conteúdo principal.

A implementação de noindex requer atenção para evitar bloquear páginas importantes por engano. Você deve auditar o site cuidadosamente para identificar quais páginas realmente não precisam ser indexadas. Candidatas comuns incluem páginas de conteúdo duplicado, páginas com pouco conteúdo e páginas criadas para navegação interna ou fins de rastreamento. Uma vez identificadas, adicione a tag noindex a essas páginas e monitore o Google Search Console para confirmar que não aparecem mais nos resultados de busca.

A solução mais eficaz a longo prazo envolve reestruturar a arquitetura do seu site para eliminar as condições que criam páginas sombra. Isso inclui consolidar conteúdo duplicado em páginas autoritativas únicas, implementar estruturas de URL adequadas que não gerem variações desnecessárias e garantir que todas as páginas importantes estejam devidamente vinculadas na navegação e no conteúdo do site.

Para conteúdo dinâmico, implemente reescrita de URLs para criar endereços limpos, com aparência estática, que não exponham IDs de sessão ou parâmetros de rastreamento. Use estruturas de URL consistentes em todo o site e garanta que todas as variações de uma página (mobile, desktop, versão para impressão) usem o mesmo endereço através de design responsivo ou negociação de conteúdo, em vez de URLs separadas. Essa abordagem não só elimina páginas sombra, mas também melhora a experiência do usuário e facilita o rastreamento e a indexação do seu site.

| Ferramenta | Finalidade | Principais Recursos |

|---|---|---|

| Google Search Console | Monitoramento oficial de indexação | Mostra páginas indexadas vs. excluídas, erros de rastreamento, problemas de cobertura |

| Screaming Frog | Auditoria técnica de SEO | Rastreia todo o site, identifica conteúdo duplicado, localiza cadeias de redirecionamento |

| Ahrefs | Análise SEO abrangente | Análise de backlinks, estimativa de orçamento de rastreamento, detecção de conteúdo duplicado |

| Semrush | Análise competitiva | Recursos de auditoria de site, problemas técnicos de SEO, status de indexação de páginas |

| Moz Pro | Conjunto de ferramentas SEO | Diagnóstico de rastreamento, identificação de conteúdo duplicado, acompanhamento de ranking |

Auditorias regulares do site são essenciais para identificar e eliminar páginas sombra antes que prejudiquem seu desempenho em SEO. O Google Search Console oferece os dados mais confiáveis sobre quais páginas o Google descobriu e indexou. O relatório de Cobertura mostra páginas excluídas e os motivos da exclusão, ajudando você a identificar páginas sombra que os buscadores decidiram não indexar. A seção de Excluídos frequentemente revela páginas sombra criadas por parâmetros de URL, paginação ou problemas de redirecionamento.

O Screaming Frog oferece um rastreamento mais abrangente de todo o seu site, simulando como os mecanismos de busca enxergam sua página. Esta ferramenta identifica conteúdo duplicado, cadeias de redirecionamento, tags canônicas ausentes e outros problemas técnicos que criam páginas sombra. Ao executar auditorias regulares com o Screaming Frog, você pode detectar problemas de páginas sombra antes que afetem significativamente o desempenho do seu SEO. A capacidade da ferramenta de identificar páginas com conteúdo semelhante ajuda a consolidar duplicatas e melhorar a estrutura do site.

Implementar boas práticas desde o início evita que páginas sombra se tornem um problema. Sempre utilize tags canônicas em páginas de conteúdo semelhante, especialmente em lojas virtuais com resultados filtrados ou conteúdo paginado. Certifique-se de que seu arquivo robots.txt não bloqueie acidentalmente páginas importantes enquanto permite que páginas sombra sejam rastreadas. Configure seu sitemap.xml para incluir apenas as páginas que você deseja indexar, excluindo páginas sombra e conteúdo raso.

Estabeleça diretrizes claras de estrutura de URL para sua equipe de desenvolvimento. Evite o uso de IDs de sessão, parâmetros de rastreamento ou indicadores de preferência do usuário em URLs. Em vez disso, implemente esses recursos por meio de cookies ou sessões no servidor que não gerem novos endereços. Para conteúdo dinâmico, use reescrita de URL para criar endereços limpos e consistentes que os mecanismos de busca possam entender e indexar facilmente.

Implemente redirecionamentos 301 corretos sempre que alterar estruturas de URL ou consolidar páginas. Monitore cadeias de redirecionamento para garantir que não excedam três saltos, já que redirecionamentos excessivos desperdiçam orçamento de rastreamento e podem causar problemas de indexação. Teste todos os redirecionamentos regularmente para confirmar que estão funcionando corretamente e apontando para as páginas de destino corretas.

Páginas sombra representam um desafio significativo para o SEO, capaz de comprometer a visibilidade e o potencial de tráfego orgânico do seu site. Ao desperdiçar orçamento de rastreamento, criar problemas de conteúdo duplicado e diluir a autoridade dos links, essas páginas impedem que seu conteúdo mais importante receba a atenção que merece dos mecanismos de busca. A boa notícia é que páginas sombra podem ser amplamente prevenidas por meio de uma arquitetura de site adequada, implementação de tags canônicas e auditorias técnicas regulares.

Eliminar páginas sombra deve ser uma prioridade em sua estratégia de SEO para 2025. Comece auditando seu site com o Google Search Console e o Screaming Frog para identificar páginas sombra existentes. Implemente tags canônicas em conteúdos duplicados, utilize diretivas noindex em páginas não essenciais e reestruture a arquitetura do seu site para evitar a formação de novas páginas sombra. Ao abordar essa questão técnica de SEO, você melhorará a eficiência do rastreamento, consolidará seu poder de ranqueamento e, finalmente, conquistará melhor visibilidade nos motores de busca e mais tráfego orgânico para o seu negócio.

Páginas sombra e problemas técnicos de SEO podem impactar significativamente o desempenho do seu marketing de afiliados. O PostAffiliatePro oferece rastreamento e análises completas para ajudar você a identificar e resolver problemas de SEO que afetam a visibilidade e as conversões do seu programa de afiliados. Monitore suas páginas de afiliados, acompanhe métricas de desempenho e garanta que todo o seu conteúdo esteja devidamente indexado e otimizado.

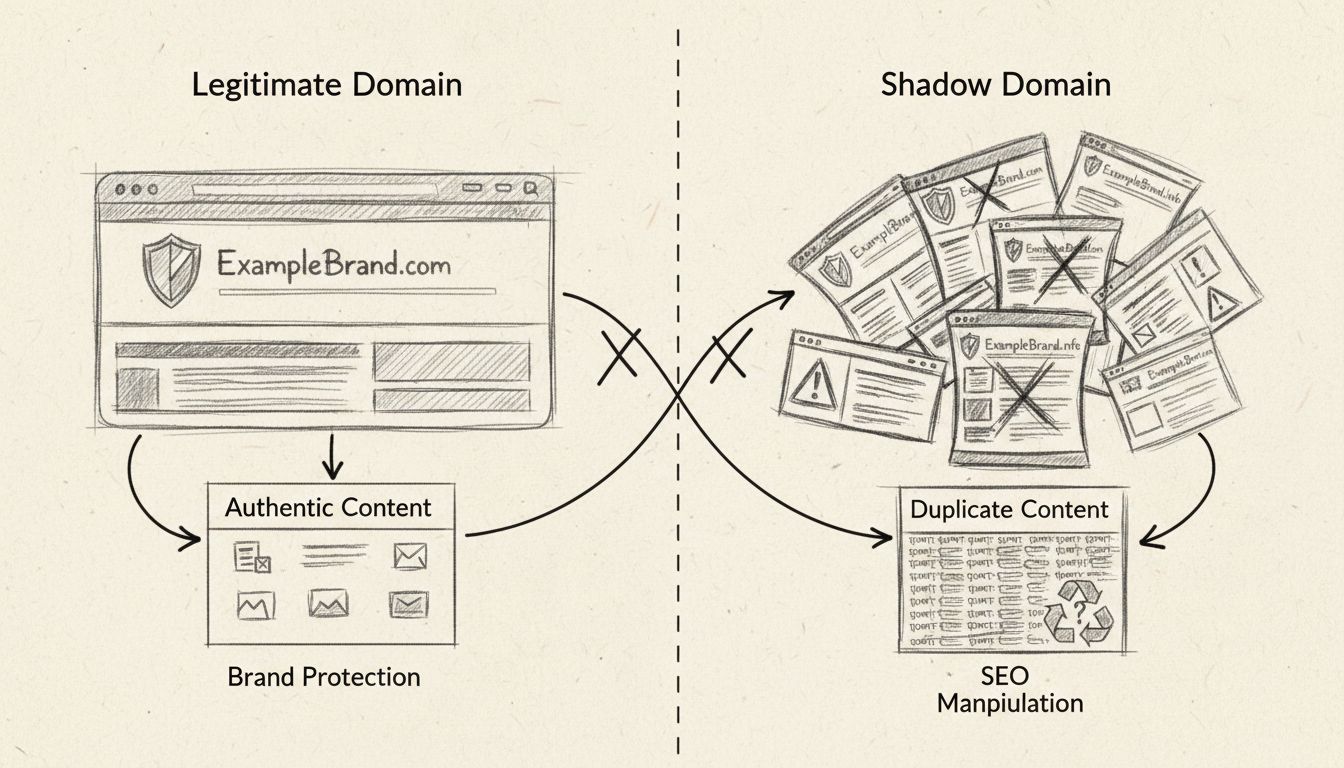

Domínios sombra são domínios não autorizados ou maliciosos que imitam sites legítimos para desviar tráfego, manipular classificações de mecanismos de busca ou r...

Descubra por que domínios shadow são táticas prejudiciais de SEO black-hat. Saiba mais sobre riscos como penalidades em buscas, desvio de tráfego, confusão de m...

Saiba por que o cloaking em SEO é prejudicial ao seu site. Descubra os riscos das técnicas de SEO black hat, penalidades do Google e por que estratégias white h...

See our privacy policy.