Como Funciona o Teste A/B? Guia Completo de Testes A/B

Aprenda como funciona o teste A/B com nosso guia completo. Descubra a metodologia, significância estatística, boas práticas e como o PostAffiliatePro ajuda a ot...

Saiba o que é o teste A/B (split testing) do Facebook e como utilizá-lo para otimizar suas campanhas de anúncios. Descubra as melhores práticas, métodos de configuração e estratégias comprovadas para aumentar seu ROI.

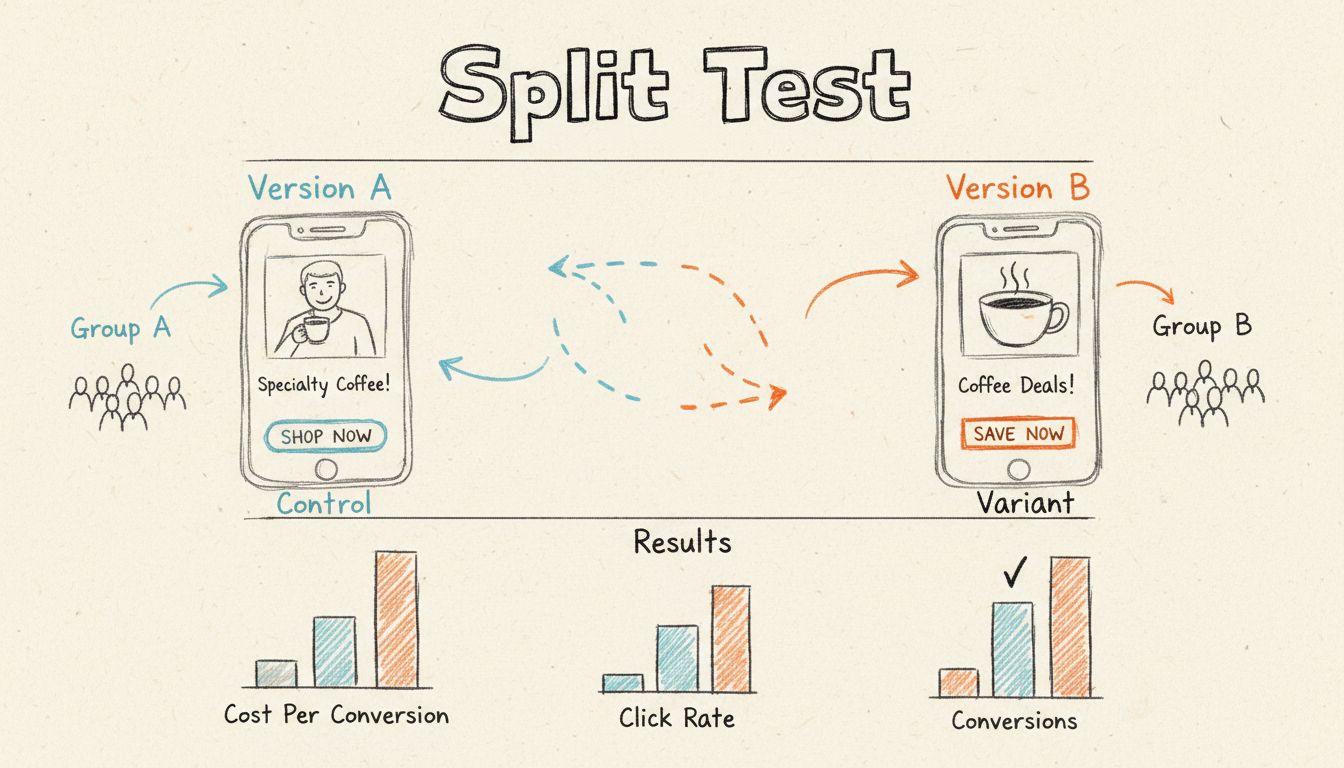

Um teste A/B no Facebook é um experimento em que duas ou mais variações de um anúncio do Facebook são exibidas para grupos diferentes de pessoas, a fim de determinar qual versão é mais eficaz em gerar resultados desejados como cliques, conversões ou compras.

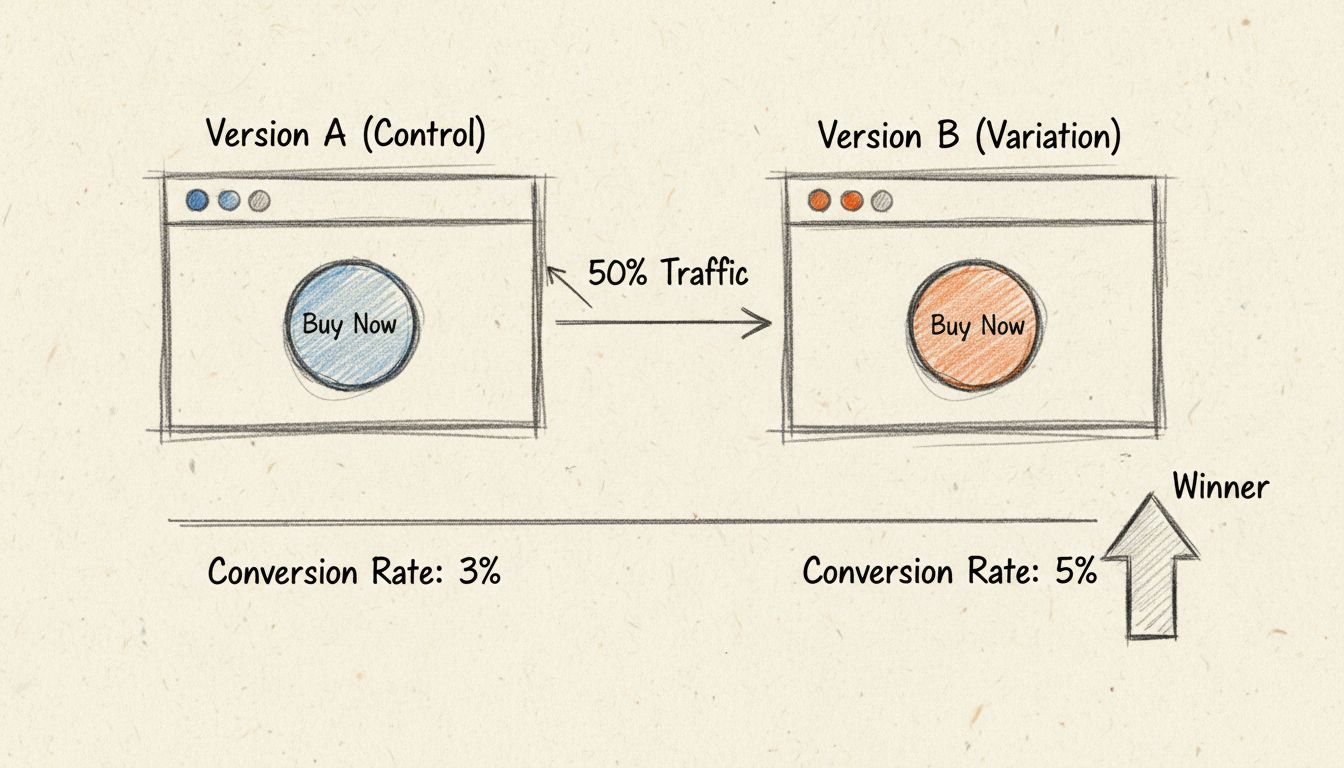

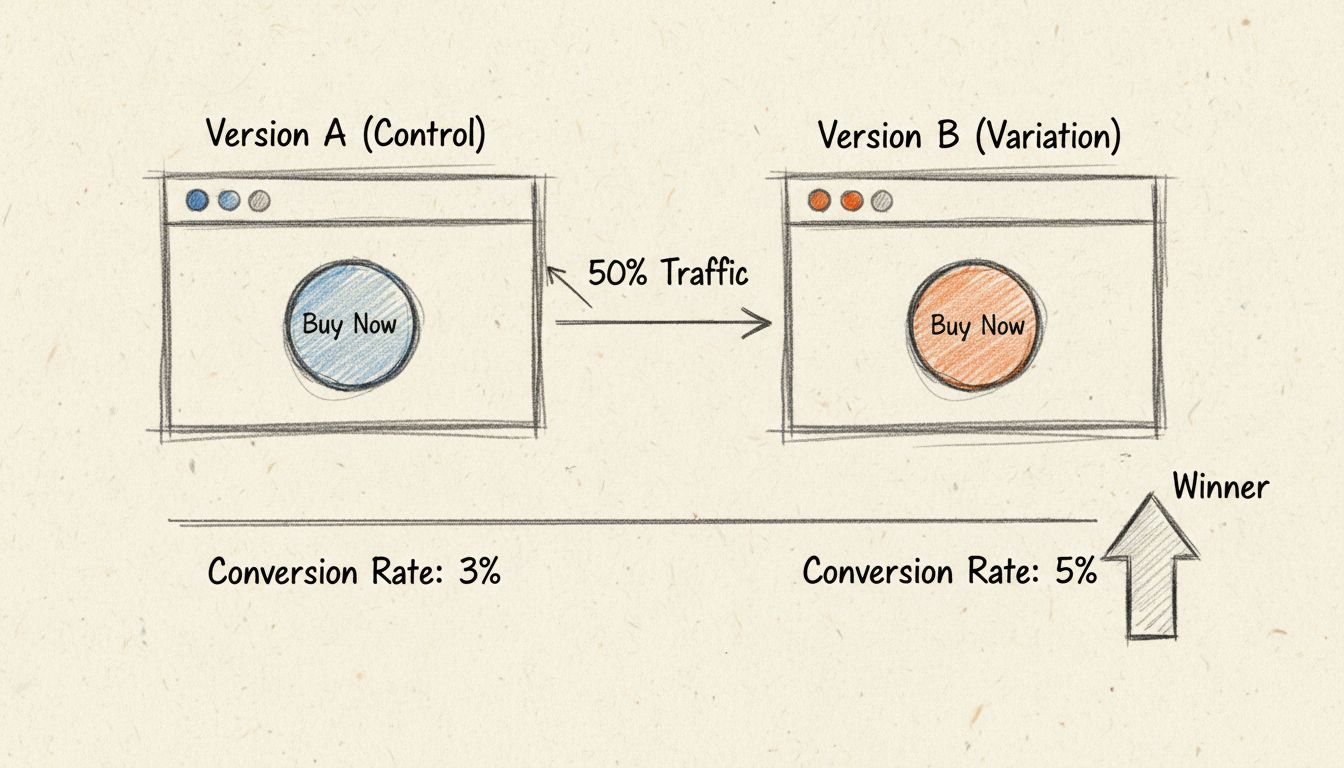

Um teste A/B, também conhecido como split testing ou teste de bucket, é um experimento controlado que compara o desempenho de duas ou mais versões de um anúncio do Facebook para determinar qual delas entrega resultados superiores. Essa metodologia isola uma variável por vez—como criativo do anúncio, segmentação de público, posicionamento ou otimização de entrega—e mede como essa alteração específica impacta os principais indicadores de desempenho da campanha. Ao executar esses experimentos de forma sistemática, anunciantes podem tomar decisões baseadas em dados, em vez de depender de suposições ou preferências pessoais sobre o que pode funcionar melhor com seu público-alvo.

O princípio fundamental por trás do teste A/B é a validação estatística. Ao realizar um teste A/B no Facebook, a plataforma divide automaticamente seu público em grupos separados, designados aleatoriamente, para garantir que cada variação receba exposição igual e a coleta de dados seja imparcial. Essa abordagem científica elimina o risco de sobreposição de público e fornece insights confiáveis sobre qual versão do anúncio terá melhor desempenho quando ampliada para todo o seu orçamento de marketing. Os resultados geralmente são apresentados com um nível de confiança, indicando a probabilidade de obter os mesmos resultados caso o teste fosse repetido.

A ferramenta de teste A/B do Facebook opera dentro do Gerenciador de Anúncios e exige que você selecione a opção de teste A/B durante a criação da campanha—não é possível adicionar teste A/B a uma campanha existente. Após escolher o objetivo da campanha, você deve especificar qual variável deseja testar. A plataforma então cria conjuntos de anúncios separados para cada variação, garantindo que seu orçamento seja distribuído igualmente (ou de acordo com sua preferência de divisão ponderada) entre todas as variações. Essa estrutura garante que cada anúncio receba impressões e interações suficientes para gerar dados estatisticamente significativos.

O algoritmo por trás do teste A/B do Facebook é projetado para minimizar vieses e maximizar a precisão dos dados. Em vez de permitir que o algoritmo de otimização do Facebook favoreça um anúncio em detrimento de outro com base em sinais de desempenho iniciais, o teste A/B mantém a alocação de orçamento igual durante todo o período do teste. Isso significa que, mesmo que uma variação pareça estar tendo melhor desempenho após alguns dias, ela não receberá uma parcela desproporcional do orçamento, o que poderia distorcer seus resultados. O teste é executado pela duração que você especificar e, ao final, o Facebook calcula qual variação atingiu o menor custo por resultado com base no objetivo da campanha.

| Variável de Teste | Descrição | Melhor Caso de Uso |

|---|---|---|

| Criativo | Diferentes imagens, vídeos, textos, títulos e chamadas para ação do anúncio | Testar qual abordagem visual ou de mensagem mais ressoa com seu público |

| Público | Diferentes segmentos demográficos, interesses, comportamentos ou públicos personalizados | Identificar qual segmento de público tem maior valor de conversão |

| Posicionamentos | Posicionamentos automáticos versus específicos (Feed, Stories, Reels, etc.) | Determinar qual posicionamento gera o melhor ROI |

| Otimização de Entrega | Diferentes estratégias de lance e objetivos de otimização (cliques, conversões, engajamento) | Encontrar o método de otimização mais econômico para seu objetivo |

| Conjunto de Produtos | Diferentes catálogos ou coleções de produtos (para e-commerce) | Identificar qual seleção de produtos gera mais vendas |

Cada uma dessas variáveis pode impactar dramaticamente o desempenho da sua campanha. Por exemplo, testar variações criativas pode revelar que um design simples e minimalista supera um design complexo e cheio de recursos em 143%, conforme demonstrado em estudos de caso reais. Da mesma forma, testes de público podem mostrar que um segmento demográfico específico tem um custo por conversão 50% menor do que seu público mais amplo, permitindo refinar significativamente sua estratégia de segmentação.

O teste A/B não é apenas um recurso interessante—é um requisito fundamental para otimizar o desempenho dos anúncios no Facebook e maximizar o retorno do investimento em publicidade. Sem o teste A/B, você basicamente está adivinhando quais elementos das suas campanhas funcionam melhor, e essas suposições frequentemente estão erradas. Pesquisas mostram que o teste A/B pode aumentar o ROI em até 10 vezes quando executado corretamente, transformando campanhas com baixo desempenho em canais de marketing altamente lucrativos. Os insights baseados em dados que você obtém dos testes A/B informam não apenas a otimização imediata da campanha, mas também sua estratégia geral de marketing e o processo de desenvolvimento criativo.

Além das melhorias imediatas de desempenho, o teste A/B oferece insights valiosos sobre as preferências e comportamentos do seu público. Quando você descobre que seu público responde melhor a textos baseados em narrativa do que em recursos do produto, ou que vídeos superam imagens estáticas por uma margem significativa, você ganha conhecimento que vai muito além de uma única campanha. Esses aprendizados podem ser aplicados ao seu marketing por e-mail, landing pages, conteúdo para redes sociais e outros canais de marketing, criando um efeito composto na efetividade geral do seu marketing.

Criar um teste A/B no Gerenciador de Anúncios do Facebook exige uma abordagem estratégica. Primeiro, é necessário estabelecer uma hipótese clara sobre o que você deseja testar e por quê. Em vez de testar variações aleatórias, um teste A/B bem-sucedido começa com uma pergunta específica: “Anúncios em vídeo geram um custo por conversão menor do que anúncios em imagem?” ou “Nossa faixa etária de 25-34 anos converte mais do que a de 35-44 anos?” Essa abordagem baseada em hipóteses garante que os resultados do teste fornecerão insights acionáveis.

Em seguida, é preciso definir a alocação de orçamento. Um teste A/B significativo requer coleta suficiente de dados, ou seja, cada variação deve gerar pelo menos 10-20 conversões antes que conclusões confiáveis possam ser tiradas. Se o seu custo médio por conversão é R$ 5 e você está testando cinco criativos diferentes, você vai precisar de um orçamento mínimo de R$ 250-500 para obter dados estatisticamente significativos. Contudo, quanto maior o orçamento disponível para o teste A/B, melhor, pois reduz o tempo necessário para atingir significância estatística e oferece dados mais robustos.

Antes de lançar seu teste A/B, é fundamental definir quais métricas determinarão o sucesso ou fracasso. As métricas mais utilizadas incluem custo por resultado (CPR), custo por clique (CPC), custo por conversão (CPA), taxa de cliques (CTR) e retorno sobre investimento em anúncios (ROAS). Entretanto, a escolha da métrica correta depende totalmente dos objetivos do seu negócio e da campanha. Para a maioria das empresas, o custo por conversão é um excelente ponto de partida, pois está diretamente correlacionado à lucratividade e ao crescimento.

Anunciantes avançados costumam acompanhar a receita gerada por cada conversão e usam o ROAS como métrica principal, já que isso reflete o impacto real de cada variação do anúncio no lucro. Se você está fazendo uma campanha de geração de leads, talvez prefira focar no custo por lead. O princípio chave é escolher uma única métrica primária para seus testes iniciais, já que monitorar várias métricas ao mesmo tempo pode gerar resultados confusos ou contraditórios. Por exemplo, um anúncio com excelente taxa de cliques pode ter um custo por conversão ruim, indicando que atrai cliques, mas esses cliques não resultam em ações valiosas.

A forma como você estrutura seu teste A/B dentro da hierarquia de campanhas do Facebook impacta significativamente a confiabilidade dos dados. Ao testar variações criativas (imagens, textos, títulos), você deve criar múltiplos anúncios dentro do mesmo conjunto de anúncios, pois eles compartilharão o mesmo público e parâmetros de segmentação. No entanto, ao testar segmentos de público ou posicionamentos, crie conjuntos de anúncios separados para cada variação, permitindo controlar a alocação de orçamento e garantir que cada segmento receba exposição igual.

Uma consideração crítica é evitar a concentração de orçamento. O algoritmo do Facebook pode ser agressivo ao alocar orçamento para o anúncio que aparenta estar “vencendo”, o que pode fazer com que uma variação receba três vezes mais impressões do que outra, distorcendo seus resultados. Para evitar isso, alguns profissionais criam conjuntos de anúncios individuais para cada variação criativa com orçamentos iguais, garantindo coleta de dados perfeitamente balanceada. Embora esse método aumente o custo total devido a múltiplos conjuntos de anúncios competindo pelo mesmo público, ele oferece resultados cientificamente mais precisos.

Muitos anunciantes cometem erros críticos ao implementar testes A/B que comprometem a qualidade dos dados. O erro mais comum é encerrar o teste cedo demais, frequentemente após apenas algumas horas ou dias, quando uma variação parece superar significativamente as demais. Na realidade, o desempenho pode mudar drasticamente ao longo do tempo, e o que aparenta ser um perdedor nas primeiras 24 horas pode se tornar o vencedor no sétimo dia. O Facebook recomenda rodar testes A/B por pelo menos 4-14 dias para considerar variações diárias no comportamento do público e garantir acumulação suficiente de dados.

Outro erro frequente é o excesso de segmentação do público. Quando você cria segmentos demais—por exemplo, testando 2 gêneros × 5 interesses × 5 faixas etárias = 50 conjuntos de anúncios diferentes—acaba com públicos muito pequenos, difíceis e caros de alcançar. O Facebook precisa trabalhar mais para encontrar usuários que atendam a critérios muito específicos, elevando seu custo por impressão e dificultando a coleta de dados relevantes. A melhor prática é começar com segmentos amplos e refinar com base nos resultados, ao invés de começar com segmentação hiper-específica.

Após a conclusão do teste A/B, o Facebook fornece os resultados em dois formatos: um e-mail e os dados de desempenho visíveis no Gerenciador de Anúncios. A plataforma identifica o conjunto de anúncios vencedor com base no menor custo por resultado e atribui um nível de confiança, indicando a probabilidade de obter o mesmo resultado se o teste fosse repetido. O Facebook normalmente declara um vencedor quando os resultados atingem 75% ou mais de nível de confiança, significando que há pelo menos 75% de chance daquela variação vencer em um novo teste.

Se seus resultados apresentarem baixa confiança (abaixo de 75%), o Facebook recomenda rodar o teste novamente com duração maior ou orçamento mais alto para coletar mais dados. Isso é comum quando duas variações têm desempenhos muito próximos, tornando impossível ao algoritmo determinar um vencedor definitivo. Após identificar um vencedor claro, você tem várias opções: pausar as variações com baixo desempenho e escalar a vencedora, redistribuir o orçamento para investir mais nas melhores enquanto mantém um orçamento mínimo nas demais, ou criar uma nova campanha usando a vencedora como controle para o próximo ciclo de teste.

Anunciantes sofisticados utilizam uma metodologia progressiva de testes, começando com variações amplas e refinando gradualmente com base nos resultados. Por exemplo, você pode testar inicialmente duas abordagens criativas muito diferentes (design minimalista versus design cheio de recursos) em um público amplo. Após identificar a direção criativa vencedora, teste variações dentro dessa abordagem (cores diferentes, títulos diferentes, diferentes chamadas para ação). Esse funil maximiza o aprendizado enquanto minimiza o desperdício de orçamento em variações desalinhadas com as preferências do público.

Outra estratégia avançada é o teste contínuo, onde você mantém uma pequena parcela do orçamento dedicada a novas variações, enquanto a maior parte sustenta os vencedores comprovados. Essa abordagem garante que você esteja sempre descobrindo novas oportunidades de melhoria, enquanto mantém o desempenho estável e previsível das campanhas principais. Os recursos avançados de rastreamento do PostAffiliatePro tornam essa estratégia particularmente eficaz, permitindo monitorar o desempenho de múltiplas variações e alocar orçamento automaticamente com base nos dados em tempo real.

O Facebook oferece várias metodologias de teste além do tradicional teste A/B. A otimização criativa dinâmica permite que você envie múltiplos ativos criativos e que o algoritmo do Facebook faça testes automáticos de combinações, exibindo as variações com melhor desempenho. Isso difere do teste A/B porque o Facebook controla a alocação de orçamento e pode transferir recursos para combinações vencedoras em tempo real. A Criatividade Dinâmica é ideal quando você tem muitos ativos criativos e deseja que o Facebook otimize automaticamente, enquanto o teste A/B é melhor quando você busca controle preciso e rigor científico.

As ferramentas Brand Lift e Conversion Lift fornecem insights mais abrangentes do que o teste A/B, medindo o impacto incremental dos seus anúncios em comparação com um grupo de controle que não vê seus anúncios. Essas ferramentas são especialmente valiosas para campanhas de grande orçamento, nas quais é importante entender não apenas qual anúncio tem melhor desempenho, mas quanto dos resultados do negócio é realmente atribuído aos anúncios. Porém, essas ferramentas exigem orçamentos maiores e períodos de teste mais longos do que o teste A/B tradicional.

O objetivo final do teste A/B é maximizar o retorno sobre o investimento em publicidade, otimizando continuamente todos os elementos das suas campanhas. Estudos de caso reais mostram o impacto dramático do teste A/B: uma empresa reduziu o custo por aquisição de R$ 4.433 por venda para R$ 123,45 por venda através de testes sistemáticos de texto e criativo do anúncio, representando uma redução de 96,72% no custo. Outro exemplo demonstrou uma melhoria de mais de 100% no custo por conversão apenas ao trocar a imagem do anúncio.

Esses resultados não são exceção—são o resultado esperado de testes A/B disciplinados e sistemáticos. Ao testar uma variável por vez, coletar dados suficientes e agir sobre os resultados, você pode melhorar consistentemente o desempenho da campanha. Quando combinado com a plataforma de rastreamento e análise abrangente do PostAffiliatePro, o teste A/B se torna ainda mais poderoso, permitindo acompanhar o desempenho em várias campanhas, identificar padrões no que funciona e aplicar esses aprendizados em todo o seu portfólio de marketing de afiliados.

Domine os testes A/B e a otimização de campanhas de afiliados com as ferramentas avançadas de rastreamento e análise do PostAffiliatePro. Acompanhe o desempenho de diversas variações de anúncios e maximize seu ROI com insights baseados em dados.

Aprenda como funciona o teste A/B com nosso guia completo. Descubra a metodologia, significância estatística, boas práticas e como o PostAffiliatePro ajuda a ot...

Descubra por que o teste A/B é fundamental para a otimização de conversões. Saiba como o teste A/B melhora resultados, reduz riscos e impulsiona o ROI. O guia e...

O teste A/B é um método de experimentação controlada em que diferentes versões de um ativo digital são apresentadas a segmentos de uma audiência para determinar...

See our privacy policy.