Como Corrigir Problemas de Conteúdo Duplicado: Guia Completo de SEO

Aprenda métodos comprovados para corrigir problemas de conteúdo duplicado, incluindo redirecionamentos 301, tags canônicas e diretivas noindex. Proteja seu ranq...

Descubra por que o conteúdo duplicado prejudica o SEO, como impacta o ranqueamento e soluções comprovadas como tags canônicas e redirecionamentos 301 para corrigir problemas de conteúdo duplicado em 2025.

Sim, o conteúdo duplicado pode impactar negativamente o SEO ao confundir os mecanismos de busca sobre qual versão ranquear, diluir a autoridade dos links entre múltiplas URLs, desperdiçar o orçamento de rastreamento e potencialmente permitir que conteúdos copiados superem suas páginas originais. Embora o Google não tenha uma penalidade específica para conteúdo duplicado, os efeitos indiretos podem prejudicar significativamente sua visibilidade nas buscas e o tráfego orgânico.

Conteúdo duplicado refere-se a conteúdos idênticos ou substancialmente semelhantes que aparecem na internet em múltiplas URLs. Isso pode ocorrer dentro de um único site ou entre diferentes domínios. Segundo dados recentes, aproximadamente 25-30% da web consiste em conteúdo duplicado, tornando-se um dos desafios técnicos de SEO mais comuns enfrentados por proprietários de sites atualmente. Quando os mecanismos de busca encontram múltiplas versões do mesmo conteúdo, eles precisam decidir qual versão é a fonte autorizada, qual será indexada e qual aparecerá nos resultados de busca. Esse processo de decisão gera várias complicações que podem afetar negativamente a visibilidade e o desempenho do tráfego orgânico do seu site.

A confusão que o conteúdo duplicado cria para os mecanismos de busca é fundamentalmente diferente de uma penalização direta. O Google já declarou explicitamente várias vezes que não possui penalidade específica para conteúdo duplicado. No entanto, isso não significa que o conteúdo duplicado seja inofensivo. Os efeitos indiretos do conteúdo duplicado podem ser tão prejudiciais ao seu desempenho em SEO quanto uma penalidade direta. Entender esses efeitos é fundamental para manter um site saudável, bem otimizado e com bom desempenho nos resultados de busca.

Mecanismos de busca como o Google utilizam algoritmos sofisticados para determinar qual versão do conteúdo duplicado deve ser indexada e ranqueada. Quando existem múltiplas versões do mesmo conteúdo, os mecanismos de busca precisam consolidar essas páginas em um chamado “cluster de duplicatas”. A partir desse cluster, o Google seleciona o que acredita ser a melhor URL para representar o conteúdo nos resultados de busca. Esse processo, conhecido como canonicalização, visa consolidar a autoridade dos links e o poder de ranqueamento em uma única URL.

No entanto, esse processo automático nem sempre funciona perfeitamente. Os mecanismos de busca podem escolher a versão errada como URL canônica, fazendo com que URLs indesejadas ou pouco amigáveis apareçam nos resultados de busca. Por exemplo, se seu site possui o mesmo conteúdo acessível em example.com/page/ e example.com/page?utm_source=newsletter, o Google pode optar por ranquear a versão com parâmetros de rastreamento ao invés da versão limpa e amigável ao usuário. Quando os usuários veem essas URLs pouco amigáveis nos resultados de busca, é menos provável que cliquem nelas, resultando em taxas de cliques menores e redução do tráfego orgânico, mesmo que a sua página esteja bem posicionada.

Um dos principais problemas do conteúdo duplicado para o SEO é a diluição da autoridade dos links. Quando o mesmo conteúdo existe em múltiplas URLs, backlinks de outros sites podem apontar para diferentes versões desse conteúdo. Em vez de toda a autoridade dos links fluir para uma página única e autorizada, ela se distribui por várias URLs duplicadas. Essa fragmentação enfraquece o sinal de autoridade geral que os mecanismos de busca usam para determinar o ranqueamento.

Considere um exemplo prático: se seu conteúdo está acessível em buffer.com/library/social-media-manager-checklist e buffer.com/resources/social-media-manager-checklist, sites externos podem linkar para qualquer uma das versões. Uma URL pode acumular 106 domínios de referência enquanto a outra acumula 144. Embora o processo de canonicalização do Google teoricamente deva consolidar esses links em uma única URL, na prática, ambas podem continuar ranqueando separadamente, impedindo a consolidação total da autoridade. Assim, acabam existindo duas páginas moderadamente fortes em vez de uma página altamente autoritativa, que poderia ranquear melhor e captar mais tráfego.

Os mecanismos de busca alocam um orçamento de rastreamento limitado para cada site, que representa o número de páginas que eles vão rastrear e indexar em determinado período. Quando seu site possui grandes quantidades de conteúdo duplicado, os mecanismos de busca desperdiçam esse orçamento precioso rastreando e revisitando páginas duplicadas ao invés de descobrir e indexar novos conteúdos ou páginas atualizadas. Isso é especialmente problemático para sites com tempo de resposta mais lento ou banda limitada, já que o limite de taxa de rastreamento do Google é maior para sites mais responsivos.

Quando o orçamento de rastreamento é desperdiçado com duplicatas, pode haver atrasos na indexação de novas páginas e na reindexação de páginas atualizadas. Isso significa que conteúdos novos podem demorar mais para aparecer nos resultados de busca, e atualizações podem não ser refletidas no índice do Google tão rapidamente quanto deveriam. Para sites com muito conteúdo ou que publicam frequentemente, esse atraso pode resultar em perda significativa de oportunidades de tráfego orgânico e visibilidade.

| Causa | Descrição | Solução |

|---|---|---|

| Parâmetros na URL | Parâmetros de rastreamento (códigos UTM), IDs de sessão e filtros criam múltiplas URLs com conteúdo idêntico | Use tags canônicas ou redirecionamentos 301 para consolidar em URLs limpas |

| HTTPS vs HTTP | Conteúdo acessível nas versões seguras e não seguras | Configure o servidor para redirecionar todo o tráfego para HTTPS |

| WWW vs Não-WWW | Conteúdo acessível em www.example.com e example.com | Defina o domínio preferencial no Google Search Console e use redirecionamentos |

| Barras Finais | URLs com e sem barra final tratadas como páginas diferentes | Implemente redirecionamentos consistentes (ex: sempre com barra final) |

| Versões Mobile | URLs mobile separadas (m.example.com) com conteúdo idêntico | Use tags rel=“alternate” ou design responsivo |

| Páginas AMP | Páginas AMP criam versões duplicadas | Canonize as páginas AMP para as versões não-AMP |

| URLs para Impressão | Versões para impressão com mesmo conteúdo | Canonize as versões para impressão para as páginas originais |

| Páginas de Tags/Categorias | Múltiplas páginas de tags com conteúdo idêntico quando apenas um artigo usa essas tags | Use noindex em páginas de tags de baixo valor ou consolide as tags |

| Paginação | Paginação de comentários ou produtos cria múltiplas páginas similares | Use rel=“prev” e rel=“next” ou noindex em páginas paginadas |

| Ambientes de Staging | Sites de desenvolvimento/staging indexados pelos buscadores | Proteja o ambiente de staging com robots.txt, noindex ou autenticação |

Embora problemas de conteúdo duplicado dentro do próprio site sejam comuns, conteúdo duplicado externo também pode prejudicar seu SEO. Quando outros sites copiam seu conteúdo ou o republicam sem permissão, eles criam duplicatas em vários domínios. Em casos raros, se o site que copiou possui autoridade de domínio maior que o seu, o Google pode identificar incorretamente a versão deles como original e ranqueá-la acima do seu conteúdo autêntico. Isso é especialmente problemático para sites novos ou menores que competem com domínios mais estabelecidos.

Para se proteger, implemente tags canônicas auto-referenciadas em todas as suas páginas. Uma tag canônica auto-referenciada aponta para a própria página, sinalizando aos mecanismos de busca que aquela é a versão autorizada. Embora nem todos os copiadores de conteúdo mantenham seu código HTML, aqueles que mantêm verão sua tag canônica e entenderão que sua versão é a original. Além disso, se você distribuir intencionalmente seu conteúdo para outros sites, sempre solicite que incluam um link canônico para o seu conteúdo original. Assim, mesmo que seu conteúdo apareça em vários lugares, todo o crédito de SEO retorna ao seu site.

A tag canônica é uma das soluções mais eficazes e amplamente usadas para gerenciar conteúdo duplicado. Esse elemento HTML indica aos mecanismos de busca qual versão de uma página deve ser tratada como fonte autorizada. A tag canônica é inserida na seção <head> do HTML e se parece com isto:

<link rel="canonical" href="https://www.example.com/page/" />

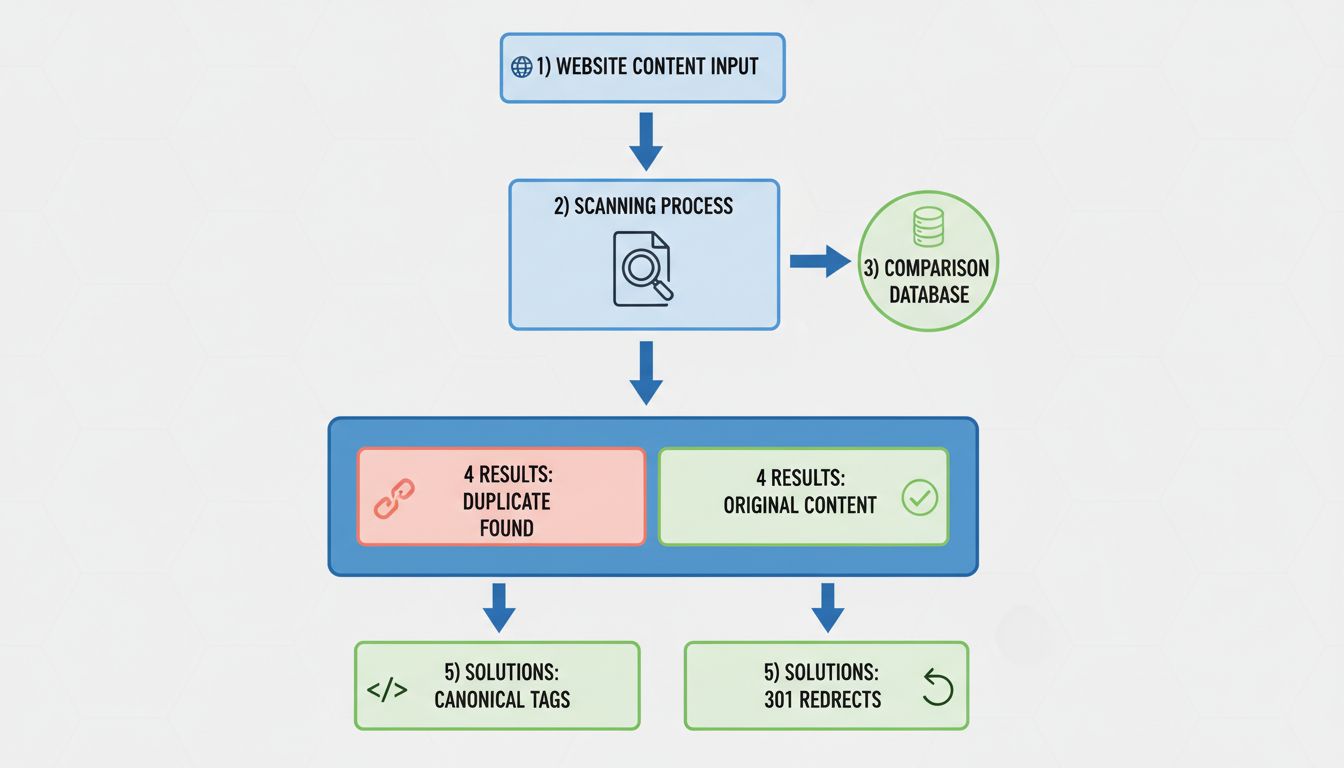

Ao adicionar essa tag em páginas duplicadas, apontando para a versão canônica (original), os mecanismos de busca consolidam o poder de ranqueamento e a autoridade dos links em uma única URL. A tag canônica transmite aproximadamente a mesma quantidade de autoridade que um redirecionamento 301, mas é mais fácil de implementar, pois não exige configuração no servidor. Isso a torna especialmente útil para gerenciar duplicatas causadas por parâmetros de URL, versões mobile e páginas AMP.

O redirecionamento 301 é um redirecionamento permanente que informa aos usuários e aos mecanismos de busca que uma página foi movida definitivamente para um novo endereço. Ao implementar redirecionamentos 301 das URLs duplicadas para a versão canônica, você consolida toda a autoridade e o poder de ranqueamento na URL de destino. Essa é geralmente a melhor solução quando se deseja eliminar completamente URLs duplicadas do site.

Por exemplo, se seu site está acessível em http://example.com e https://www.example.com, implemente redirecionamentos 301 para que todo o tráfego e os rastreadores sejam direcionados para a versão preferida. Assim, os mecanismos de busca indexam apenas uma versão do seu site, prevenindo problemas de conteúdo duplicado. O redirecionamento 301 transfere quase 100% da autoridade dos links para a página de destino, sendo uma excelente escolha para consolidar duplicatas.

A tag meta robots noindex é especialmente útil para gerenciar conteúdo duplicado que você deseja manter acessível aos usuários, mas não quer que seja indexado pelos mecanismos de busca. Ao adicionar <meta name="robots" content="noindex,follow"> no <head> da página, você informa aos mecanismos de busca para não indexar aquela página, mas ainda permite que eles sigam os links nela.

Essa solução é ideal para gerenciar conteúdo duplicado de paginação, páginas de tags, páginas de filtros e outras páginas automáticas que não agregam valor único. No entanto, é importante observar que o Google ainda rastreia essas páginas para verificar a diretiva noindex, portanto, você não deve bloqueá-las no arquivo robots.txt. A tag noindex é menos eficaz do que tags canônicas ou redirecionamentos 301 em termos de consolidação de autoridade, mas é uma ótima forma de evitar que páginas duplicadas de baixo valor poluam seus resultados de busca.

Para identificar problemas de conteúdo duplicado, realize regularmente auditorias completas do site usando ferramentas especializadas de SEO. Essas ferramentas rastreiam todo o site e identificam páginas com conteúdo idêntico ou quase idêntico. Ao revisar os resultados da auditoria, procure clusters de páginas duplicadas sem tags canônicas corretas — eles serão destacados como problemas que precisam de atenção.

O Google Search Console também oferece informações valiosas sobre conteúdo duplicado. O Relatório de Cobertura mostra quais páginas o Google indexou e sinaliza problemas como “Duplicada sem canônica selecionada pelo usuário” ou “Duplicada, Google escolheu canônica diferente do usuário”. Esses alertas indicam que o Google detectou conteúdo duplicado no seu site e pode não estar tratando-o da forma desejada. A ferramenta de Inspeção de URL do Search Console permite verificar como o Google trata URLs específicas, mostrando se uma página está indexada, canonicalizada ou bloqueada da indexação.

Prevenir conteúdo duplicado é muito mais fácil do que corrigi-lo depois. Comece estabelecendo padrões claros de URL para o seu site e mantenha a consistência em toda a estrutura do site. Ao criar links internos, sempre utilize a mesma versão das URLs — não misture versões com e sem www, ou com e sem barra final. Essa consistência ajuda os mecanismos de busca a entenderem sua estrutura preferida de URLs.

Para sites de e-commerce que usam navegação facetada com filtros e ordenações, implemente o manuseio correto de parâmetros para evitar a criação de centenas de páginas duplicadas. Use tags canônicas para consolidar visualizações filtradas para a página base do produto, ou utilize a ferramenta de manuseio de parâmetros do Google Search Console para informar ao Google quais parâmetros devem ser ignorados ao rastrear o site.

Se você usa um CMS como WordPress, desative recursos que criam automaticamente conteúdo duplicado, como páginas dedicadas para anexos de imagens e comentários paginados. A maioria das plataformas modernas de CMS oferece configurações para controlar esses comportamentos. Além disso, proteja seus ambientes de desenvolvimento e staging contra indexação usando diretivas robots.txt, tags meta noindex ou autenticação HTTP, evitando que versões duplicadas do site sejam rastreadas.

Embora o Google não aplique uma penalização específica para conteúdo duplicado, os efeitos indiretos podem prejudicar significativamente o desempenho de SEO do seu site. O conteúdo duplicado confunde os mecanismos de busca sobre qual versão ranquear, dilui a autoridade dos links entre múltiplas URLs, desperdiça o orçamento de rastreamento e pode permitir que conteúdo copiado supere suas páginas originais. Implementando tags canônicas, redirecionamentos 301 e uma estrutura de URLs adequada, você previne e corrige problemas de conteúdo duplicado antes que eles prejudiquem sua visibilidade nas buscas.

A chave para manter um site saudável é ser proativo na gestão do conteúdo duplicado. Audite regularmente seu site, implemente estratégias corretas de canonicalização e mantenha padrões consistentes de URLs em todo o site. Com essas ações, você garante que os mecanismos de busca identifiquem facilmente seu conteúdo autoritativo, consolidem autoridade nas URLs preferenciais e rastreiem e indexem seu site com eficiência. Isso resulta em melhores ranqueamentos, aumento do tráfego orgânico e uma performance de SEO mais forte para o seu site.

Gerencie múltiplos programas de afiliados e previna problemas de conteúdo duplicado com os recursos avançados de rastreamento e gestão de conteúdo do PostAffiliatePro. Garanta que seus esforços de marketing de afiliados gerem o máximo valor em SEO.

Aprenda métodos comprovados para corrigir problemas de conteúdo duplicado, incluindo redirecionamentos 301, tags canônicas e diretivas noindex. Proteja seu ranq...

Saiba como verificar conteúdo duplicado usando ferramentas como Copyscape, Siteliner e Google Search Console. Descubra métodos manuais, detecção interna de dupl...

Conteúdo duplicado refere-se a conteúdos idênticos ou semelhantes que aparecem em múltiplas URLs, seja dentro de um único site ou entre diferentes sites. Embora...

See our privacy policy.