Por Que o Teste A/B é Importante?

Descubra por que o teste A/B é fundamental para a otimização de conversões. Saiba como o teste A/B melhora resultados, reduz riscos e impulsiona o ROI. O guia e...

Aprenda como funciona o teste A/B com nosso guia completo. Descubra a metodologia, significância estatística, boas práticas e como o PostAffiliatePro ajuda a otimizar suas campanhas de afiliados por meio de testes baseados em dados.

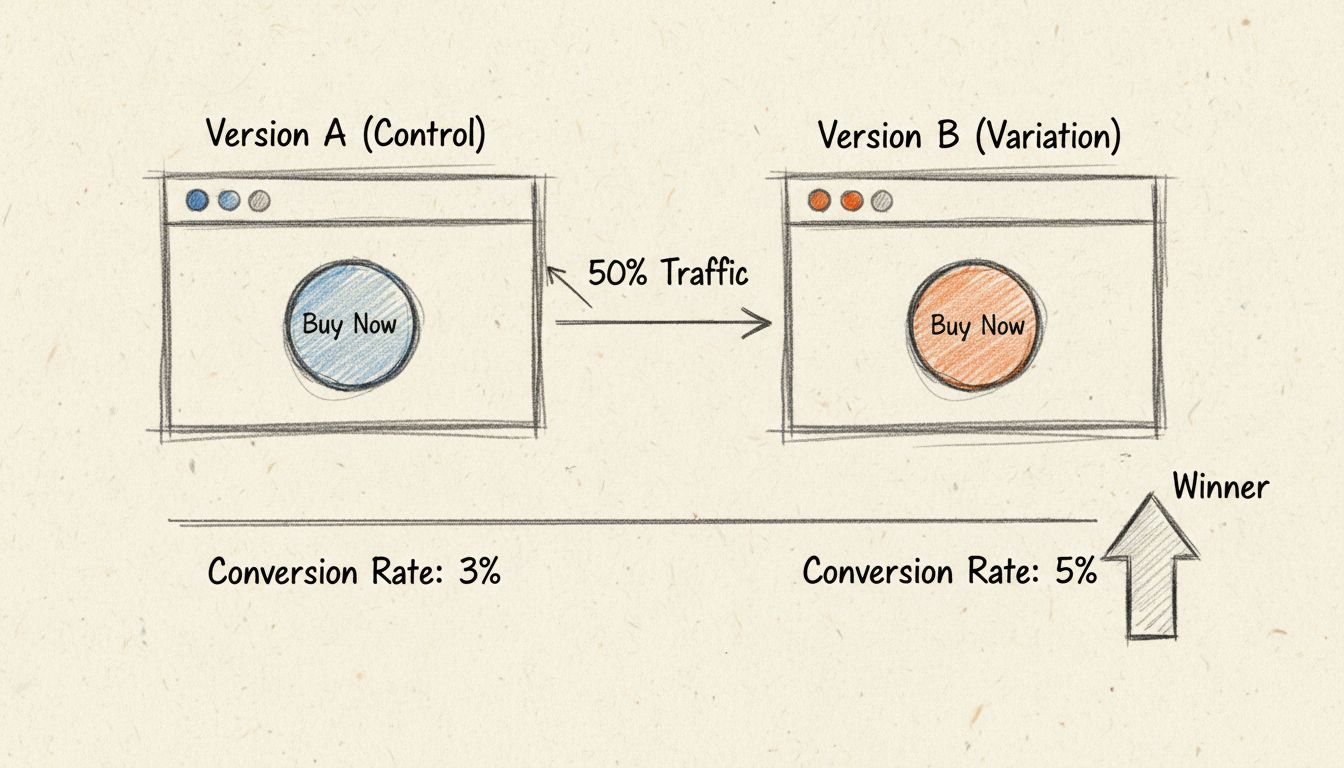

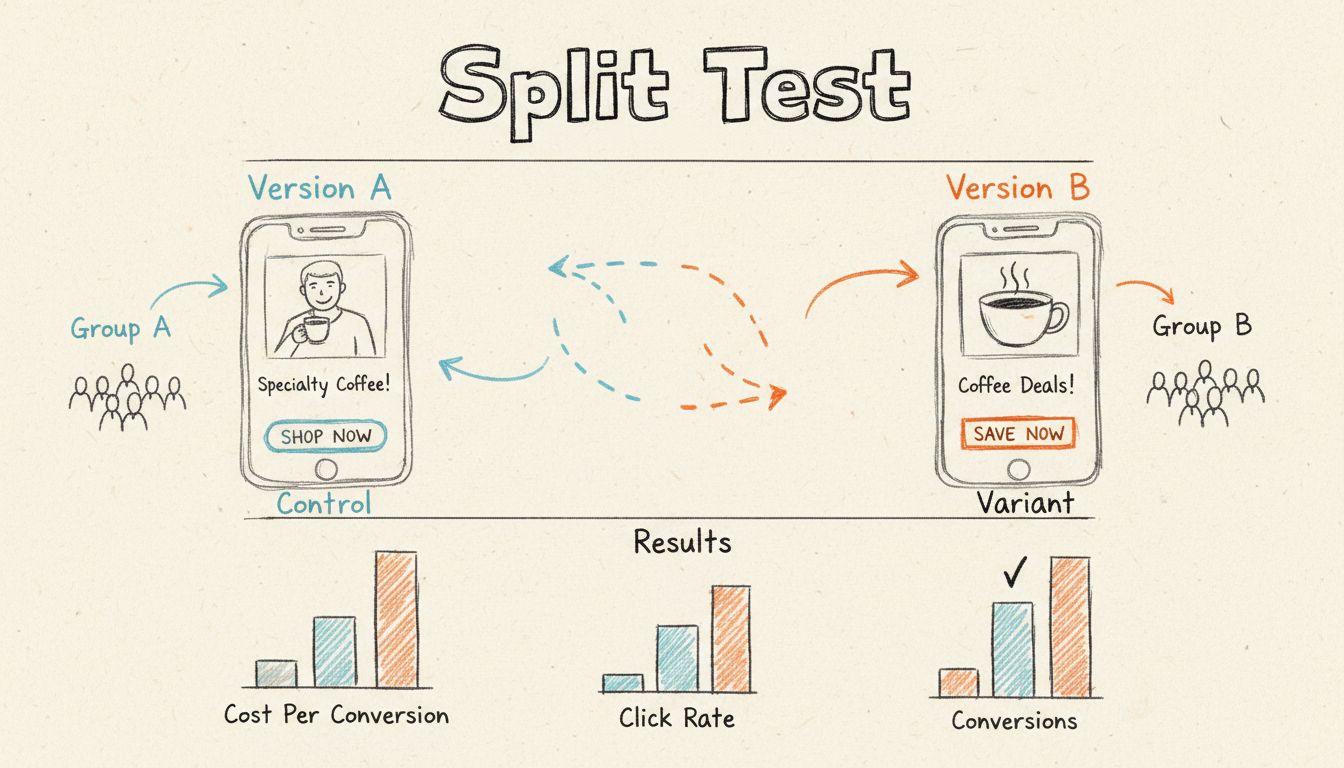

O teste A/B, também conhecido como split testing, funciona dividindo sua audiência em dois grupos iguais e mostrando a cada grupo uma versão diferente de uma página, e-mail ou ativo digital. Ao medir como cada versão se sai em métricas-chave como taxas de conversão, você pode determinar qual é mais eficaz e implementar a variação vencedora para otimizar seus resultados.

O teste A/B, também chamado de split testing ou teste de bucket, é uma metodologia de experimentação controlada que compara duas ou mais versões de um ativo digital para determinar qual apresenta melhor performance. O princípio central é simples: divida sua audiência em segmentos aleatórios e iguais e exponha cada segmento a uma versão diferente da sua página, e-mail, anúncio ou outro material de marketing. Medindo métricas de performance como taxas de conversão, taxas de clique, níveis de engajamento ou receita gerada, você pode tomar decisões baseadas em dados sobre qual versão implementar permanentemente. Essa abordagem elimina o achismo da otimização de marketing e o substitui por evidências empíricas, tornando-se uma das ferramentas mais poderosas disponíveis para profissionais de marketing e gestores de afiliados modernos.

A principal diferença entre o teste A/B e outros métodos de otimização é sua dependência de análise estatística e condições controladas. Em vez de fazer mudanças baseadas em intuição, preferência pessoal ou feedbacks anedóticos, o teste A/B fornece provas quantificáveis do que realmente funciona com o seu público específico. Isso é especialmente valioso no marketing de afiliados, onde até pequenas melhorias nas taxas de conversão podem se traduzir em aumentos significativos de receita em toda a sua rede.

O processo de teste A/B começa com a identificação de um elemento específico que você deseja otimizar. Pode ser qualquer coisa: a cor de um botão de call-to-action, o assunto de um e-mail, o título de uma landing page ou uma imagem de produto. Depois, você cria duas versões: o controle (sua versão original) e a variação (a versão modificada com uma ou mais mudanças). O princípio crítico aqui é alterar apenas uma variável por vez, garantindo que qualquer diferença de performance possa ser atribuída diretamente àquela alteração, e não a múltiplos fatores.

Quando suas versões estiverem prontas, você implementa um mecanismo de divisão de tráfego que atribui visitantes de forma aleatória ao controle ou à variação. Idealmente, essa divisão deve ser 50/50, ou seja, metade do seu público vê a versão A e a outra metade vê a versão B. Essa randomização é essencial para eliminar viés de seleção e garantir que ambos os grupos sejam estatisticamente comparáveis. Ferramentas modernas de teste A/B automatizam esse processo, usando algoritmos para garantir atribuição verdadeiramente aleatória e evitando que o mesmo usuário veja múltiplas versões.

Conforme o tráfego passa por ambas as versões, a plataforma de teste coleta dados sobre como os usuários interagem com cada uma. Isso inclui o rastreamento das métricas de sucesso pré-definidas—seja envios de formulários, compras, aberturas de e-mails, cliques em links ou qualquer outra ação significativa. Os dados se acumulam ao longo do tempo, e é realizada uma análise estatística para determinar se as diferenças observadas são estatisticamente significantes ou apenas fruto da variação aleatória.

Um dos aspectos mais críticos do teste A/B, frequentemente negligenciado pelos profissionais de marketing, é o conceito de significância estatística. Um resultado estatisticamente significante significa que você pode confiar que a diferença observada entre o controle e a variação é real e não devido ao acaso. O padrão do mercado para significância estatística é de 95%, o que significa que há apenas 5% de probabilidade de os resultados terem ocorrido aleatoriamente.

Alcançar significância estatística requer um tamanho de amostra adequado. Se você rodar um teste com apenas 10 visitantes por variação, flutuações aleatórias podem distorcer seus resultados. Mas, com milhares de visitantes por variação, os padrões ficam claros e confiáveis. O tamanho da amostra necessário depende de vários fatores: sua taxa de conversão base, o menor efeito que deseja detectar e o nível de confiança desejado. Por exemplo, se sua taxa de conversão base é 2% e você quer detectar uma melhora relativa de 25% (indo para 2,5%), precisará de uma amostra maior do que se estivesse testando uma melhoria de 100%.

Existem duas abordagens estatísticas principais usadas em testes A/B: o método Frequentista e o método Bayesiano. O Frequentista requer amostras maiores e períodos de teste mais longos para alcançar significância estatística, tornando-o menos ideal para sites com pouco tráfego. O Bayesiano, cada vez mais popular em plataformas modernas, pode chegar a conclusões acionáveis com amostras menores e prazos mais curtos—às vezes 50% mais rápido que métodos Frequentistas. Isso torna o teste Bayesiano especialmente valioso para programas de afiliados e sites menores.

| Elemento | Descrição | Importância |

|---|---|---|

| Hipótese | Uma previsão clara sobre qual mudança melhorará a performance e por quê | Crítico - orienta todo o teste |

| Versão Controle | Sua versão original, sem alterações, servindo de base | Essencial - ponto de comparação |

| Variação | A versão modificada com uma ou mais mudanças específicas | Essencial - testa sua hipótese |

| Divisão de Tráfego | Atribuição aleatória de visitantes ao controle e variação (normalmente 50/50) | Crítico - garante resultados imparciais |

| Métrica de Sucesso | O KPI específico que você está medindo (conversões, CTR, receita etc.) | Crítico - define o que é “vencer” |

| Tamanho da Amostra | Número de visitantes/interações necessários para significância estatística | Crítico - determina a confiabilidade do teste |

| Duração do Teste | Quanto tempo o teste deve rodar antes da análise | Importante - afeta a qualidade dos dados |

| Nível de Confiança | Limite de certeza estatística (normalmente 95%) | Importante - determina a validade do resultado |

O teste A/B não se limita a um único canal ou tipo de ativo. Gestores de afiliados e profissionais de marketing podem aplicar essa metodologia em vários pontos de contato. Para campanhas de e-mail, você pode testar tópicos como linhas de assunto, texto de pré-visualização, nome do remetente, cores de botões de call-to-action ou estrutura do conteúdo. Testar apenas as linhas de assunto pode revelar diferenças significativas nas taxas de abertura—algumas empresas já observaram melhorias de 20-30% otimizando esse único elemento.

Para landing pages, as oportunidades de teste A/B são abundantes. Você pode testar títulos, imagens de destaque, campos de formulário, posicionamento de botões, elementos de prova social como depoimentos, mensagens de proposta de valor ou até mesmo o layout inteiro da página. O teste A/B em landing pages é especialmente valioso no marketing de afiliados porque pequenas melhorias nas taxas de conversão se multiplicam em toda a sua rede de afiliados.

Linhas de assunto de e-mails merecem atenção especial porque impactam diretamente as taxas de abertura, que, por sua vez, influenciam as taxas de clique e conversão. Testar variações como personalização (“João, veja sua oferta exclusiva” vs. “Oferta exclusiva aqui”), urgência (“Somente 48h: tempo limitado” vs. “Nova oferta disponível”) ou mensagens focadas em benefício (“Economize 40% em recursos premium” vs. “Aumente sua produtividade agora”) pode gerar resultados surpreendentes.

Plataformas de publicidade paga como Google Ads e Meta oferecem recursos integrados de teste A/B. Você pode testar textos de anúncios, títulos, imagens, vídeos, botões de call-to-action e destinos de landing page. Testar várias variações de anúncios simultaneamente ajuda a identificar quais elementos criativos mais ressoam com seu público-alvo.

Passo 1: Identifique Oportunidades – Analise seus dados de performance atuais usando ferramentas como Google Analytics. Procure páginas ou campanhas com alto tráfego, mas baixas taxas de conversão, altas taxas de rejeição ou métricas de engajamento ruins. Esses são candidatos ideais para teste A/B porque têm mais espaço para melhoria e alto volume de tráfego para alcançar significância estatística rapidamente.

Passo 2: Formule uma Hipótese – Com base em sua análise e compreensão do comportamento do usuário, desenvolva uma hipótese específica sobre qual mudança melhorará a performance. Por exemplo: “Adicionar depoimentos de clientes acima da dobra aumentará a taxa de conversão em 15% porque a prova social reduz a ansiedade de compra.” Uma boa hipótese é específica, mensurável e fundamentada em lógica.

Passo 3: Crie Variações – Desenvolva as variações do teste, alterando apenas um elemento de cada vez. Se estiver testando uma landing page, mantenha tudo igual, exceto o título. Se estiver testando um e-mail, altere apenas a linha de assunto, mantendo o corpo e o CTA idênticos. Esse isolamento garante que qualquer diferença de desempenho possa ser atribuída à mudança específica.

Passo 4: Configure o Teste – Use sua plataforma de teste A/B para configurar o teste. Especifique a porcentagem de tráfego para cada variação (normalmente 50/50), defina suas métricas de sucesso, seu nível de confiança e estabeleça o menor efeito detectável. Plataformas modernas cuidam automaticamente da randomização e divisão do tráfego.

Passo 5: Execute o Teste – Inicie o teste e deixe rodar até atingir significância estatística. Isso é crucial—interromper um teste cedo porque os resultados preliminares parecem promissores é um erro comum que leva a conclusões pouco confiáveis. Fatores como horário, dia da semana, sazonalidade e mix de fontes de tráfego podem influenciar os resultados, então é essencial garantir uma duração adequada.

Passo 6: Analise os Resultados – Quando a significância estatística for atingida, analise os resultados. Compare controle e variação conforme suas métricas pré-definidas. Se a variação vencer, implemente-a como novo padrão. Se o controle vencer, você obteve informações importantes sobre o que não funciona. Se os resultados forem inconclusivos, considere testar outro elemento ou aumentar o tamanho da amostra.

Passo 7: Itere e Otimize – Use os aprendizados do teste para planejar testes futuros. Se descobriu que depoimentos aumentam conversões, teste diferentes tipos de depoimentos. Se uma cor de botão performa melhor, teste essa cor em outras páginas. Testes contínuos criam uma cultura de otimização que gera melhorias acumulativas ao longo do tempo.

Muitas organizações prejudicam seus esforços de teste A/B por erros evitáveis. Testar múltiplas variáveis ao mesmo tempo impossibilita saber qual alteração causou os resultados. Sempre teste um elemento por vez para manter a clareza sobre a causa. Encerrar testes precocemente é outro erro crítico—resultados iniciais podem ser enganosos devido à variação aleatória, e você precisa de tamanho de amostra adequado para ter conclusões confiáveis.

Ignorar a significância estatística leva à implementação de mudanças que parecem funcionar, mas são apenas flutuações aleatórias. Sempre verifique se os resultados atingem o nível de confiança estabelecido antes de tomar decisões. Não considerar fatores externos como tendências sazonais, campanhas de marketing ou alterações no site pode distorcer os resultados. Se estiver rodando um teste durante um grande feriado ou período promocional, os resultados podem não refletir o comportamento normal dos usuários.

Testar com tráfego insuficiente impede que se alcance significância estatística, tornando o teste inconclusivo. Se seu site tem pouco tráfego, considere métodos estatísticos bayesianos ou teste elementos de maior impacto que possam mostrar efeitos maiores. Alterar parâmetros do teste durante a execução prejudica a validade estatística dos resultados. Estabeleça seus parâmetros antes de iniciar e mantenha-os.

Enquanto o teste A/B compara duas versões, o teste multivariado permite que você teste múltiplas variáveis simultaneamente. Por exemplo, você pode testar duas variações de título combinadas com duas imagens diferentes, criando quatro combinações. Porém, o teste multivariado exige amostras significativamente maiores, pois o tráfego é dividido entre mais variações. É recomendado apenas para sites de alto tráfego.

Segmentação de audiência adiciona outro nível de sofisticação ao teste A/B. Você pode descobrir que diferentes segmentos respondem de formas distintas às variações. Por exemplo, tráfego de redes sociais pode preferir um tom mais informal, enquanto o tráfego orgânico prefere abordagem profissional. Ao segmentar os resultados, você pode identificar esses padrões e até implementar versões diferentes para segmentos distintos, maximizando a performance geral.

No marketing de afiliados, especificamente, o teste A/B deve focar em métricas que impactam diretamente a receita. Taxa de conversão é fundamental—a porcentagem de visitantes que completam uma ação desejada. Taxa de cliques (CTR) mede quantos clicam no call-to-action. Ticket médio (AOV) mostra se as variações influenciam o valor das compras. Valor do tempo de vida do cliente (CLV) indica se as variações atraem clientes de maior qualidade, que compram mais de uma vez.

Taxa de rejeição revela se a variação mantém os visitantes engajados ou os faz sair imediatamente. Tempo na página indica engajamento com o conteúdo. Receita por visitante combina taxa de conversão e ticket médio em uma métrica única. Para programas de afiliados, é essencial rastrear quais variações geram os leads mais qualificados para seus anunciantes—uma variação pode aumentar o tráfego, mas atrair visitantes de menor qualidade que não convertem.

O teste A/B transforma o marketing de um arte baseada em intuição para uma ciência baseada em dados. O efeito cumulativo da otimização contínua é poderoso: uma melhoria de 10% na taxa de conversão, multiplicada por milhares de visitantes mensais, se traduz em aumentos substanciais de receita. Empresas que adotam o teste A/B superam consistentemente concorrentes que dependem do achismo. O PostAffiliatePro oferece a infraestrutura de rastreamento e as capacidades analíticas necessárias para rodar testes A/B sofisticados em toda sua rede de afiliados, permitindo identificar variações vencedoras e escalá-las para obter o máximo impacto.

Domine o teste A/B para maximizar as taxas de conversão do seu programa de afiliados. O PostAffiliatePro oferece ferramentas avançadas de rastreamento e análise para ajudar você a realizar testes A/B eficazes e identificar o que gera os melhores resultados.

Descubra por que o teste A/B é fundamental para a otimização de conversões. Saiba como o teste A/B melhora resultados, reduz riscos e impulsiona o ROI. O guia e...

O teste A/B é um método de experimentação controlada em que diferentes versões de um ativo digital são apresentadas a segmentos de uma audiência para determinar...

Saiba o que é o teste A/B (split testing) do Facebook e como utilizá-lo para otimizar suas campanhas de anúncios. Descubra as melhores práticas, métodos de conf...

See our privacy policy.